2026年1月、IPA(情報処理推進機構)が発表した「情報セキュリティ10大脅威 2026」で、「AIの利用をめぐるサイバーリスク」が初選出にしていきなり3位にランクインしました。約250名のセキュリティ専門家が投票で選んだこの結果は、AI情報漏洩がもはや一部の先進企業だけの問題ではなく、日本企業全体の経営課題になったことを意味しています。

実際、Cyberhaven Labsの調査(2025年3月)によれば、従業員がAIツールに入力する企業データのうち34.8%が機密情報であり、この数字は2年前(10.7%)の3倍超に急増しています。

本記事では、IPA・総務省・OWASP・Cyberhaven・Gartner・WEFなど14の一次情報に基づき、AI情報漏洩の「なぜ起きるのか」「どこで起きるのか」「どう防ぐのか」を体系的に解説します。

AI導入におけるセキュリティリスクについては、こちらの記事でも詳しく解説しています。

AI情報漏洩とは?いま注目される背景

IPA「10大脅威2026」で初選出された意味

IPA「情報セキュリティ10大脅威 2026」の組織向けランキングは、以下のとおりです。

注目すべきは、ランサムウェアやサプライチェーン攻撃といった長年の脅威と並んで、AIリスクが初登場から3位に入ったという事実です。IPAは、このリスクを3つの観点から整理しています。

- AI利用時のリスク(利用者観点):AIに対する不十分な理解に起因する意図しない情報漏えいや、他者の権利侵害

- AIそのものへの攻撃(開発・提供者観点):AIモデルやシステムを直接狙ったサイバー攻撃

- AIを悪用した攻撃の高度化(社会観点):攻撃者がAIを利用してフィッシングやマルウェアを高度化する

本記事が焦点を当てるのは、多くの企業にとって最も身近でありながら対策が遅れがちな「①AI利用時のリスク」、すなわちAI情報漏洩の問題です。

生成AI利用の爆発的拡大が生んだ新しいリスク

AI情報漏洩がここまで深刻化した背景には、生成AIの利用が爆発的に拡大した事実があります。

総務省「令和7年版 情報通信白書」(2025年)によると、日本における個人の生成AI利用経験は26.7%に達し、2023年度の9.1%から約3倍に拡大しました。20代では44.7%が利用経験ありと回答しています。なお国際比較では、米国68.8%、ドイツ59.2%、中国81.2%と日本の利用率はまだ低く、今後さらに拡大する余地があります。

企業側の状況も急速に変化しています。総務省の同調査では、生成AI導入の懸念事項として「社内情報の漏えい等のセキュリティリスク」が上位にあがり、約7割の企業がセキュリティリスクを懸念していることが明らかになっています。

Cyberhaven Labsの調査(Q2 2025 AI Adoption & Risk Report)はさらに衝撃的です。職場でのAI利用頻度は過去12ヶ月で4.6倍、24ヶ月で61倍に増加しました。テック企業では従業員の38.9%がAIツールを日常的に利用しています。

こうした状況を受け、Gartner(2024年10月)の調査では、日本のセキュリティリーダーの57.2%が「AI等によるデータ活用の拡大について不安」と回答しました。すでにサイバー攻撃による情報漏洩が発生した企業は34%、インサイダーによる情報漏洩が発生した企業も27.7%に上っています。

世界経済フォーラムも指摘するAIリスクの拡大

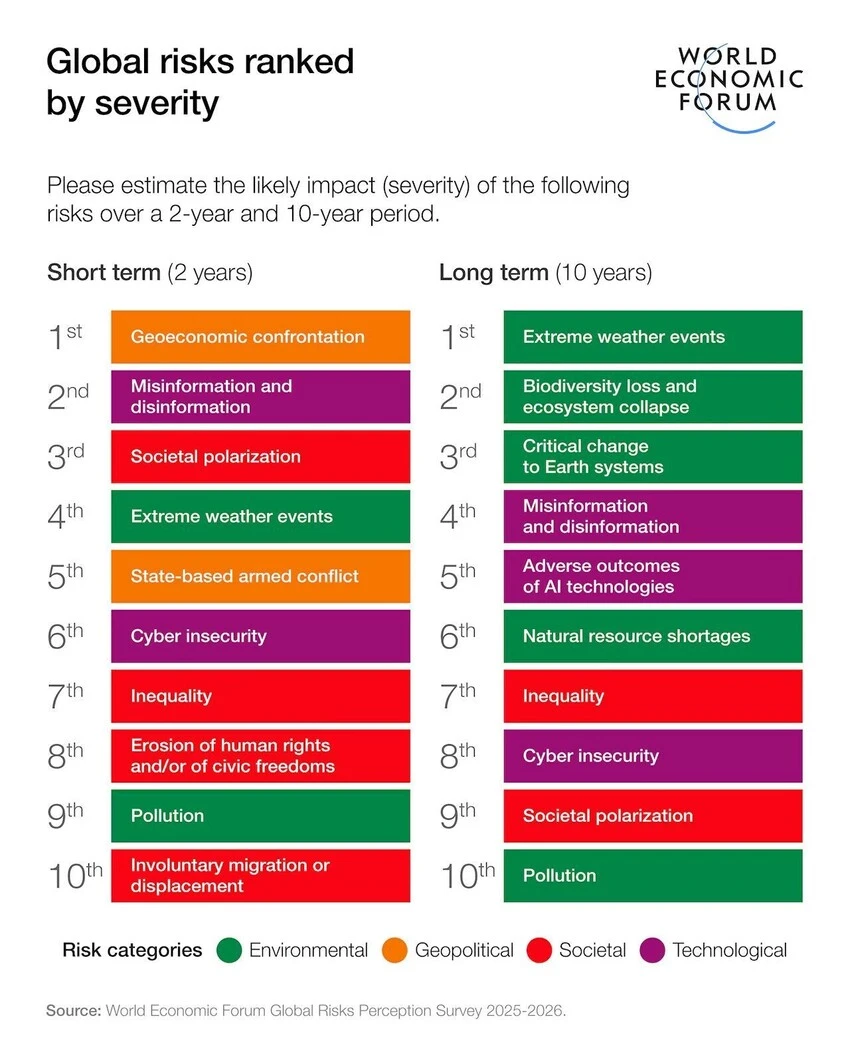

こうした懸念は日本に限ったものではありません。世界経済フォーラム(WEF)が発表した「グローバルリスク報告書2026」では、「AIの悪影響(Adverse outcomes of AI)」が10年見通しで5位にランクされました。この項目は2年見通しでは30位にとどまっていましたが、長期的にはより深刻な脅威と見なされています。

また、AIが生成する誤情報・偽情報は2年見通しで2位、サイバーセキュリティの不安は6位に位置づけられており、AI関連のリスクが複合的に社会を脅かしつつある構図が読み取れます。

AI情報漏洩が起きる5つの経路【体系的分類】

AI情報漏洩と一口に言っても、そのリスクは単一ではありません。本章では、OWASP「Top 10 for LLM Applications 2025」の分類体系を軸に、日本企業の実態に即した5つの経路を整理します。自社にとってどの経路のリスクが高いかを判断する材料にしてください。

【経路①】従業員による機密情報の誤入力(最も頻度が高い)

最も発生頻度が高く、かつ対策が困難なのが、従業員が業務中にAIツールへ機密情報を入力してしまうケースです。

Cyberhaven Labsの調査では、従業員がAIツールに貼り付けるデータの34.8%が機密情報に該当します(2025年3月時点)。2年前の10.7%から3倍超に増加しており、機密データの種類別ではソースコードが18.7%で最多、次いでR&D資料が17.1%、営業・マーケティングデータが10.7%と続いています。

さらに深刻なのは、ChatGPTアカウントの73.8%が個人(非企業)アカウントで利用されているという事実です。個人アカウントにはエンタープライズ級のセキュリティ設定(学習オプトアウトやデータ保持ポリシー等)が適用されません。また、全データ流出の80%はわずか0.9%の従業員が占めているという偏りも報告されています。

事例:サムスン電子(2023年4月)

サムスン電子のエンジニアが、半導体のソースコードをChatGPTに入力してデバッグを依頼した事例は、この経路の典型例です。当時、学習データへの取り込みをオプトアウトする設定が行われておらず、社外秘のソースコードが外部のAIシステムに取り込まれるリスクが発生しました。サムスンはこの事例を受け、社内でのChatGPT使用を全面的に禁止する措置をとりました。

【経路②】AIサービス側のシステム脆弱性・バグ

利用者側がどれだけ注意しても、AIサービス提供者側のシステムに脆弱性があれば情報漏洩は発生し得ます。

OWASP「Top 10 for LLM Applications 2025」では、「LLM02:機密情報の開示(Sensitive Information Disclosure)」が前年の6位から2位に急上昇しました。OWASPは「モデル出力を通じた個人情報や機密データの漏洩が、プライバシー侵害や競争上の損失につながる」と警告しています。

事例:OpenAI ChatGPTバグ(2023年3月)

オープンソースライブラリ(Redis)のバグにより、他のユーザーのチャット履歴のタイトルが表示される障害が発生しました。さらに、有料会員(ChatGPT Plus)の氏名、メールアドレス、クレジットカード番号の下4桁と有効期限なども一部のユーザーに閲覧可能な状態になりました。

事例:リートン(Wrtn)データベース設定不備(2024年3月)

韓国発のAIサービス「リートン」では、データベースの設定不備により、ユーザーのプロンプト(AIへの質問・指示内容)や登録情報が第三者に閲覧・編集可能な状態で公開されていたことが判明しました。ニックネーム、メールアドレス、LINE IDなどの個人情報がアクセス可能でした。

【経路③】プロンプトインジェクションによる意図的な情報抽出

3つ目の経路は、悪意ある攻撃者がプロンプト(AIへの入力)を巧みに操作し、本来取得できないはずの情報を引き出す手法です。

OWASP「Top 10 for LLM Applications 2025」では、「LLM01:プロンプトインジェクション」が引き続き1位を維持しています。直接的注入(ユーザーが悪意のある指示をプロンプトに埋め込む)と間接的注入(外部ソース経由での注入)の2種類が存在します。

さらに、2025年版では「LLM07:システムプロンプトの漏洩(System Prompt Leakage)」が新たに追加されました。システムプロンプトとはAIの動作を定義する内部指示であり、ここにはAPIキー、データベース認証情報、ユーザー権限情報などが含まれている場合があります。

事例:Bing AI 内部指示抽出(2023年2月)

米国の大学生がプロンプトインジェクション手法を用いて、MicrosoftのBing AI(現Copilot)の非公開指示や開発コードネームを抽出することに成功しました。

事例:ChatGPT「poem」無限リピート(2023年後半)

研究者が特定の単語を無限にリピートさせるプロンプトをChatGPTに入力したところ、学習データが逐語的に出力される現象が発見されました。出力された内容には、実名、メールアドレス、電話番号といった個人情報が含まれていました。

【経路④】マルウェアによるAIアカウント情報の窃取

AIサービスそのものではなく、利用者のアカウント情報がマルウェアによって窃取される経路です。

Group-IBの調査(2023年6月)によると、ダークウェブ上で10万件超のChatGPTアカウント情報が売買されていることが検出されました。これは「インフォスティーラー」と呼ばれる情報窃取型マルウェア(Redline、Lumma等)によるもので、アジア太平洋地域が最多を占め、日本からも約660件の流出が確認されています。2023年5月には月間26,802件に達しました。

さらに2025年2月には、ダークウェブ上に大手生成AIサービスのアカウント認証情報約2,000万件の出品が確認されました。セキュリティ企業の検証では、AIサービス側のシステムが直接侵害された形跡はなく、RedlineやLumma等のインフォスティーラー経由で収集された可能性が高いとされています。

窃取されたアカウントにはチャット履歴が残っている場合が多く、過去にAIへ入力した機密情報が第三者に閲覧されるリスクがあります。

【経路⑤】学習データ・RAGからの意図しない情報露出

5つ目は、AIの学習データやRAG(検索拡張生成)システムから意図せず情報が露出する経路です。

OWASP「Top 10 for LLM Applications 2025」では、関連する脅威として以下が挙げられています。

- LLM04:データおよびモデルポイズニング — 学習データの汚染を通じた情報流出や動作改変

- LLM08:ベクトルとエンベディングの脆弱性(2025年版で新設) — RAGシステムやベクターデータベースを標的とした攻撃

特にLLM08は、エンベディング反転(ベクトル表現からソーステキストを再構成する手法)のリスクを指摘しています。企業が社内文書をRAGシステムに組み込んでいる場合、適切なアクセス制御がなければ、本来アクセス権のないユーザーが機密文書の内容を間接的に取得できてしまう可能性があります。

また、「Proof Pudding」攻撃(CVE-2019-20634)では、開示された学習データを手がかりにモデル抽出・反転が可能になり、セキュリティ制御を突破できることが示されました。

【データで見る】AI情報漏洩のリスクはどれほど深刻か

ここまで5つの経路を解説しましたが、具体的にどの程度のリスクが存在するのでしょうか。本章では、定量データを集中的に提示します。社内での稟議や上申にも活用できる水準のエビデンスです。

企業データ流出の実態(Cyberhaven最新統計)

Cyberhaven Labsの継続調査から、企業データ流出の推移と実態を時系列で整理します。

| 指標 | 数値 | 出典時期 |

|---|---|---|

| AIに入力される企業データ中の機密情報割合 | 34.8% | 2025年3月 |

| 同・1年前 | 27.4% | 2024年3月 |

| 同・2年前 | 10.7% | 2023年3月 |

| 機密データの内訳(上位3カテゴリ) | ソースコード 18.7%、R&D資料 17.1%、営業データ 10.7% | 2025年 |

| ChatGPTに機密データを貼り付けた経験のある従業員 | 4.7% | 2023年累計 |

| ChatGPTアカウントのうち非企業アカウント比率 | 73.8% | 2024年 |

| Geminiアカウントの非企業アカウント比率 | 94.4% | 2024年 |

| AI利用に伴う企業データ流出量の増加 | 前年比 485%増 | 2023→2024年 |

| 全データ流出の80%を占める従業員の割合 | わずか0.9% | 2023年 |

(出典:Cyberhaven Labs Q2 2024 / Q2 2025 AI Adoption & Risk Report)

特に注目すべきは、2年間で機密情報の入力割合が10.7%→34.8%と約3.3倍に増加している点です。AIツールが業務インフラとして定着するにつれ、従業員がAIに渡すデータの質(機密度)が急速に上がっていることを示しています。

また、Geminiアカウントの94.4%が個人アカウントという数字は、Google Workspace等のエンタープライズ環境と切り離された形でAIが利用されている実態を浮き彫りにしています。

日本企業特有のリスク要因

グローバルのデータに加え、日本企業には固有のリスク要因が存在します。

総務省「令和7年版 情報通信白書」によると、日本の中小企業の約半数が生成AIの活用方針を「明確に定めていない」状態です。大企業ではポリシー策定が進んでいる一方、中小企業との差が顕著であり、サプライチェーン全体のセキュリティを考えると看過できない問題です。

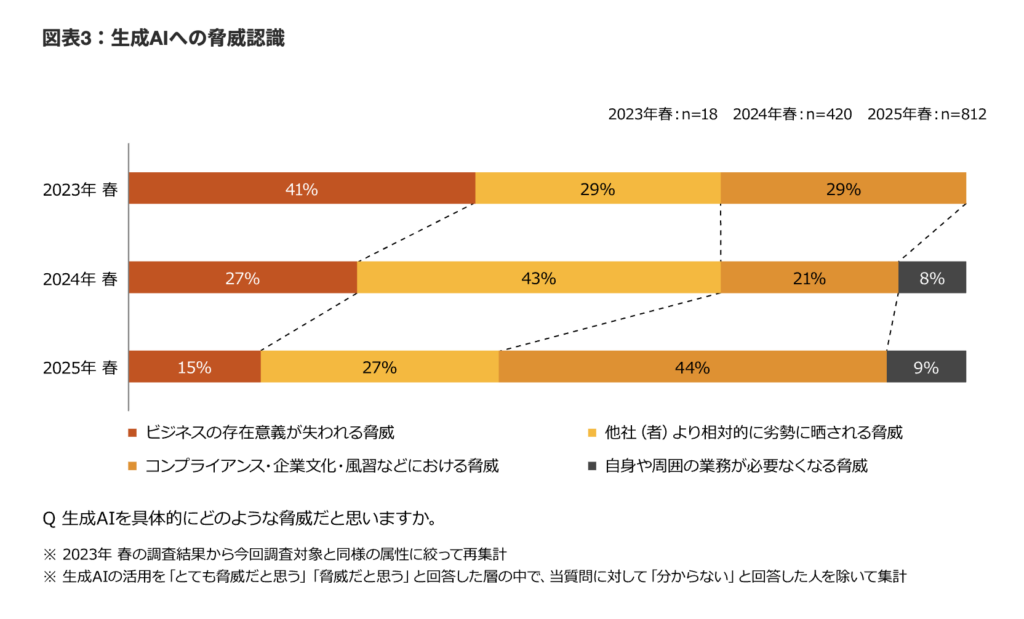

PwC「生成AIに関する実態調査2025春 5カ国比較」では、生成AIに対する脅威認識として「コンプライアンス・企業文化・風習における脅威」が44%(前年比+23ポイント)に達しました。日本はAI活用の推進度こそ平均的ですが、効果創出の水準が他国よりも低いと指摘されています。つまり、リスクは認識しつつも、それを適切にマネジメントして効果につなげる体制が不十分ということです。

帝国データバンクの調査(2024年6月〜7月)では、生成AIを活用している企業は17.3%にとどまりますが、活用企業の約9割が一定の効果を実感しています。一方で、「経営者」と「一般社員」のAI活用に対する理解に大きなギャップがあることも報告されており、現場でのシャドーAI利用(IT部門が把握していないAI利用)が拡大するリスクを示唆しています。

AI情報漏洩を防ぐための実践的対策

リスクの深刻さを確認したうえで、ここからは具体的な対策を解説します。対策は「組織」「技術」「法的」「検証」の4層で構成し、既存記事にありがちな「ガイドラインを作りましょう」「研修を実施しましょう」にとどまらない、実装レベルの具体性を目指します。

【組織対策】AI利用ポリシーの策定と周知

まず取り組むべきは、AI利用に関する組織的なルールの整備です。

内閣府は「生成AIサービスの利用に関する注意喚起」(2023年6月2日)の中で、「個人情報取扱事業者が生成AIサービスに個人情報を含むプロンプトを入力する場合には、特定された当該個人情報の利用目的を達成するために必要な範囲内であること」と明記しています。同委員会はOpenAIに対しても、個人情報保護法第147条に基づく注意喚起を実施しました。

また、経済産業省・総務省の「AI事業者ガイドライン 第1.1版」(2025年3月28日)では、AI利用者・開発者・提供者それぞれの主体が考慮すべき事項が整理されています。

これらを踏まえたうえで、企業が実施すべき具体的なアクションは以下の3点です。

① 機密情報の入力禁止を原則とし、例外は承認制にする

「何を入力してよいか」ではなく「原則として機密情報は入力禁止、例外は上長承認を経て個別に許可」という設計にすることで、判断の曖昧さを排除できます。

② エンタープライズ版AIの利用を義務化する

Azure OpenAI ServiceやChatGPT Enterprise、Google Workspace向けGeminiなど、学習データへの取り込み禁止やデータ保持ポリシーが保証されたエンタープライズ版の利用を義務化します。個人アカウントでの業務利用を明確に禁止することが、シャドーAI対策の第一歩です。

③ 入力可能データをランク分けして明示する

「公開情報 → 入力可」「社内限定情報 → 入力可」「秘密情報 → 入力不可」「個人情報 → 入力不可」のように、データ分類に応じた入力可否を明確に定め、全従業員に周知します。

【技術対策】シャドーAIの可視化と制御

組織的なポリシーだけでは、現場での遵守を担保できません。技術的な可視化と制御が不可欠です。

Cyberhaven Labsの調査によれば、Geminiアカウントの95.9%が個人アカウントであり、IT部門が把握・管理できていない「シャドーAI」の利用が常態化しています。さらに、AI開発者ツール(CursorやCline等)の導入により、利用量がわずか4ヶ月で400%増加するケースも報告されています。

Gartner(2024年10月)は、新しい情報漏洩対策として「フィロソフィの転換」を提唱しています。従来の「境界を作って内部は自由にアクセス」という考え方から、「過剰なアクセス権の付与をなくす」という方向への転換です。具体的には、ユーザー・データ種類・作業範囲といった小さな単位で暗号化・権限付与を行い、AIツールへのデータ流出をきめ細かく制御することが求められています。

【法的対策】法規制への対応

AI情報漏洩に関連する法規制は、国内外で急速に整備が進んでいます。

EU AI Act(AI規制法) は2024年8月に発効し、段階的に施行が進んでいます。2025年8月には禁止AIシステムの規定が適用開始となり、2026年8月には高リスクAIシステムの要件が適用されます。違反時の罰金は最大3,500万ユーロまたは年間売上の7%(いずれか高い方)と極めて厳格です。EU域内で事業を行う日本企業や、EU居住者のデータを扱う企業は対応が必須です。

個人情報保護法 については、いわゆる「3年ごと見直し」が進行中であり、AI開発等を含む統計作成等のみを目的とした取り扱いの本人同意のあり方などが検討されています。

不正競争防止法 では、生成AIに投入した秘密情報が出力として現れた場合の秘密管理性の評価が問題となり得ます。経済産業省の営業秘密管理指針では、ログ管理とアクセス制御の重要性が改めて確認されています。

【検証対策】第三者によるAIリスク評価の重要性

4つ目の対策層として、独立した第三者による検証の重要性を指摘します。

ここまで解説してきたとおり、AI情報漏洩の経路は多岐にわたり、技術的にも急速に変化しています。ここで問題になるのは、従来のセキュリティ対策だけではAI固有のリスクに対応しきれないという点です。

OWASP「Top 10 for LLM Applications 2025」が示すように、プロンプトインジェクション、システムプロンプト漏洩、エンベディング脆弱性といったAI固有の脅威は、従来のDLP(データ損失防止)ツールでは検知が困難です。Cyberhaven自身も「従来のセキュリティ製品はChatGPTの利用を適切に監視できない」と指摘しています。

また、AI利用ポリシーを策定しても、実際の運用状況を客観的に検証する仕組みがなければ、ポリシーは容易に形骸化します。利用しているAIツールのセキュリティ設定が本当に安全かどうかは、ベンダーの自己申告を鵜呑みにすべきではありません。

こうした構造的な課題に対応するためには、ベンダーから独立した第三者の視点で、AIツールの選定・導入・運用プロセスを客観的に評価する仕組みが不可欠です。ポリシー策定(組織対策)、技術的制御(技術対策)、法令対応(法的対策)に加え、それらが実効性を持って運用されているかを検証する「第四の層」として、第三者検証を位置づけることを推奨します。

まとめ:AI活用とセキュリティを両立するために

本記事では、IPA・総務省・OWASP・Cyberhaven・Gartner・WEFなどの一次情報に基づき、AI情報漏洩のリスクと対策を体系的に解説しました。

ポイントを整理します。

AI情報漏洩リスクの深刻化は数字が証明しています。 IPAが初めて10大脅威に選出し(3位)、OWASPでは機密情報開示が2位に急上昇、Cyberhaven調査ではAIへの機密データ入力が2年間で3.3倍に増加しています。

リスクは5つの経路に分類できます。 従業員の誤入力、AIサービス側の脆弱性、プロンプトインジェクション、マルウェアによるアカウント窃取、学習データ・RAGからの情報露出です。各企業は自社に該当するリスクを特定し、優先順位をつけて対策を実施する必要があります。

対策は4層構造で実装すべきです。 ポリシー策定(組織対策)、シャドーAI制御(技術対策)、法令対応(法的対策)、そして第三者検証の4層を組み合わせることで、「攻めのAI活用」と「守りのセキュリティ」を両立できます。

AI技術の進化は止まりません。だからこそ、リスクを正しく理解し、エビデンスに基づいた対策を講じることが、企業のAI活用を持続可能なものにする唯一の道です。

AIツールの導入・運用に際して、セキュリティリスクの客観的な評価を行いたい企業様は、Aixisの第三者AI監査サービスをご活用ください。ベンダーから完全に独立した立場で、貴社のAI活用状況を診断し、リスクと対策を明確にします。