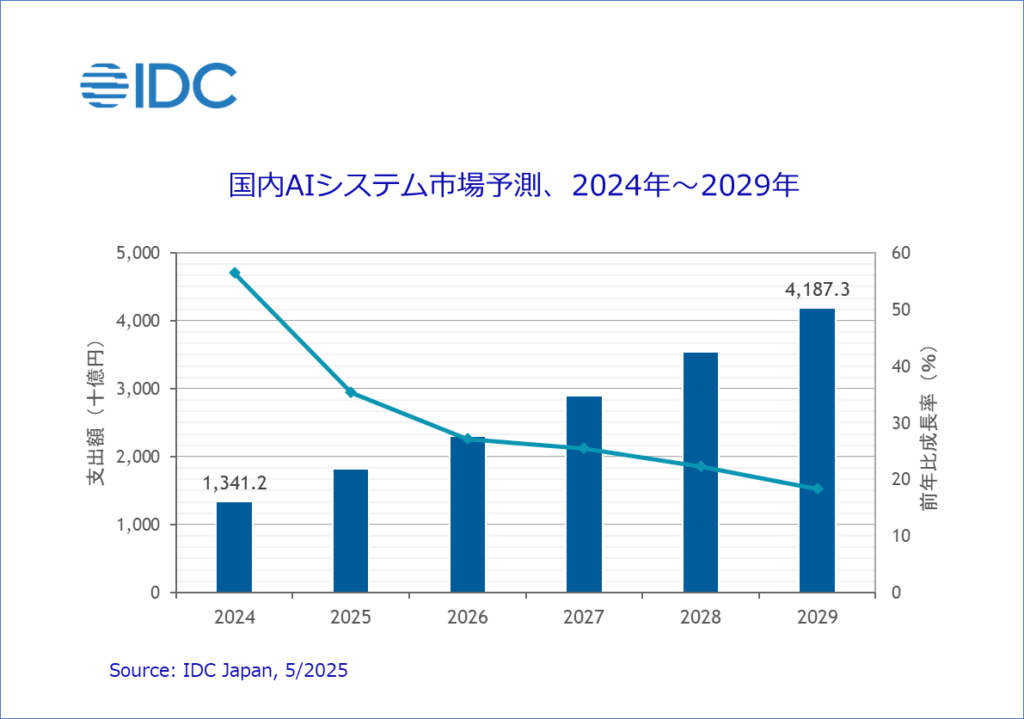

1兆3,412億円。

これは、IDC Japanが発表した2024年の国内AIシステム市場の規模です。前年比56.5%増。そして2029年には4兆1,873億円——わずか5年で3倍に膨れ上がると予測されています。

企業がAIに投じる金額は、年々、桁違いに大きくなっています。

ここで一つ、根本的な問いを投げかけたい。

これほどの金額が動く市場で、なぜ「買い手」を守る仕組みが何もないのでしょうか。

すべての市場には「審判」がいる——AIを除いて

私たちの社会では、高額な買い物をする際に「売り手の言い分だけで判断しなくて済む仕組み」が、当たり前のように整備されています。

少し振り返ってみてください。

自動車を買うとき。あなたはディーラーの営業担当の言葉だけで300万円を払うでしょうか。日本にはJNCAP(自動車アセスメント)という仕組みがあります。国土交通省と独立行政法人・自動車事故対策機構(NASVA)が共同で運営し、市販されている自動車の安全性能を衝突試験を含む客観的なテストで評価し、結果を一般に公開しています。

注目すべきは、その運営の独立性です。テスト車両は、NASVAの職員が身分を隠して一般ユーザーとしてディーラーから購入しています。メーカーが用意した「特別仕様車」ではなく、あなたや私が買うのとまったく同じ車でテストする。この徹底した公平性が、消費者の信頼の基盤になっています。

JNCAPの存在は、消費者を守るだけではありません。自動車メーカーに対して「より安全な車を作れば高い評価が得られる」というインセンティブを生み出しました。結果として、1995年の制度開始以来、日本車の安全性能は飛躍的に向上しています。独立した評価制度が、市場全体の品質を底上げしたのです。

金融商品を買うとき。投資信託を購入する前に、あなたは目論見書(もくろみしょ)を確認します。そこにはリターンだけでなくリスクが、過去の実績だけでなく手数料の全体像が、法律に基づいて開示されています。格付け機関(ムーディーズ、S&P、フィッチ)は、発行体から独立した立場で信用力を評価し、投資家の判断材料を提供しています。2008年のリーマンショックで格付け機関の在り方は大きな批判を受けましたが、「独立した第三者が評価する」という仕組み自体の必要性を否定する人はいません。むしろ、その独立性をもっと厳格にすべきだという議論が起きたのです。

食品を買うとき。原材料名、アレルギー表示、栄養成分、賞味期限——食品表示法に基づく統一的な表示基準があるから、あなたは異なるメーカーの商品を棚の上で比較できます。特定保健用食品(トクホ)は、消費者庁の審査を経て初めてその表示を許可されます。

住宅を買うとき。住宅性能表示制度があり、耐震等級、省エネ性能、劣化対策など10分野について、第三者の登録住宅性能評価機関が評価します。これは2000年の「住宅の品質確保の促進等に関する法律」に基づく制度です。

自動車、金融商品、食品、住宅。いずれも高額であったり、判断を誤った場合のダメージが大きい買い物です。だからこそ、売り手から独立した第三者の評価や情報開示の仕組みが整備されている。

では、AIツールはどうでしょうか。

年間数百万円から数千万円の投資。導入に失敗すれば、金銭的損失だけでなく、業務の混乱、現場のモチベーション低下、「次のAI案件」への社内の拒否反応。その影響は計り知れません。

にもかかわらず、AIツール市場には——

独立した第三者による性能評価制度が、ありません。 ベンダー間を横断する共通の評価基準が、ありません。 性能数値の測定条件に関する開示義務が、ありません。 導入後の効果検証を第三者が行う仕組みが、ありません。

1兆円を超える市場に、審判がいない。

これは「異常」と呼ぶべき状態ではないでしょうか。

なぜAIだけ「野放し」なのか——3つの構造的理由

この異常事態には、構造的な理由があります。単に「制度が追いついていない」という話では済みません。

理由1:技術の進化速度が、制度設計を追い越してしまった

自動車のJNCAPは1995年に始まりました。自動車の基本的な安全性能指標(衝突時の乗員保護性能、ブレーキ制動距離など)は、数十年をかけて標準化されたものです。

一方、AIツール市場はどうでしょうか。ChatGPTが一般に公開されたのは2022年11月。そこからわずか3年余りで、市場は1兆円規模にまで爆発的に成長しました。テキスト生成、画像認識、音声認識、コード生成、エージェント型AI——カテゴリすら毎月のように増えている状況で、「共通の評価軸」を定めること自体が至難の業です。

しかし、「難しい」と「やらなくていい」は違います。困難であることは、不在の正当化にはなりません。

理由2:ベンダー側に「第三者評価」を求めるインセンティブがない

自動車メーカーがJNCAPのファイブスター大賞をCMで大々的にアピールするのは、消費者が安全性能を重視して購入判断を行うからです。つまり、独立評価が売上に直結するインセンティブがある。

AIツール市場では、この構造が成立していません。企業の購買担当者やIT部門は、AIツールの性能を客観的に比較する「共通の物差し」を持っていません。だから、ベンダーの営業資料やデモ、そして「他社の導入事例」に依存せざるを得ない。比較の枠組み自体が存在しないため、ベンダーにとっては自社に都合の良い土俵で戦える現状のほうが有利なのです。

第三者評価が存在しないことは、ベンダーにとって問題ではありません。買い手にとってだけ、問題なのです。

理由3:「AIに詳しい人」がベンダー側に偏在している

最も根深い問題です。

AIツールの性能を正しく評価するには、高度な専門知識が必要です。モデルのアーキテクチャ、学習データの品質、推論速度とコストのトレードオフ、セキュリティリスク——これらを理解できる人材は、現状では圧倒的にベンダー側(AIツール開発企業、SIer、コンサルティング会社)に集中しています。

買い手である一般企業の側には、ベンダーの主張を技術的に検証できる人材がほとんどいません。PwCの2025年調査でも、日本企業が生成AI活用で直面する最大の課題として「必要なスキルを持った人材がいない」が挙げられています。

この人材の偏在が、情報の非対称性を極端に拡大しています。売り手が圧倒的に詳しく、買い手はほとんど何もわからない。この状態で公正な取引が成立するはずがありません。

医療の世界を想像してみてください。患者(買い手)と医師(売り手)の間には、圧倒的な知識の非対称性があります。だからこそ、医療にはインフォームド・コンセント(十分な説明に基づく同意)の仕組みがあり、セカンドオピニオンの権利があり、医療機関の第三者評価制度があるのです。

AIツール市場には、そのどれもありません。

「Gartnerがあるじゃないか」という反論に答える

ここで、よくある反論に触れておきます。

「Gartnerのマジック・クアドラントがあるではないか」「IT調査会社がベンダー比較レポートを出している」——確かにその通りです。しかし、これらは本稿が述べている「格付け機関」とは根本的に性質が異なります。

Gartnerをはじめとする調査会社のレポートは、本質的に市場分析です。ベンダーの戦略、ビジョン、市場ポジションを評価するものであり、特定のツールが「あなたの会社の、あなたの業務で、どの程度の性能を発揮するか」を検証するものではありません。

さらに重要な点があります。これらの調査会社は、ベンダーからも収益を得ています。ベンダーはGartnerのレポートに掲載されるために多額のコストをかけ、掲載されれば営業ツールとして活用します。これは利益相反(コンフリクト・オブ・インタレスト)を完全に排除した構造とは言えません。

私が述べているのは、もっと泥臭い話です。

JNCAPがやっているように、身分を隠して市販品を購入し、標準化された条件でテストし、買い手のためだけに結果を公開する——そのレベルの独立性を持った評価機関が、AIツール市場には存在しないということです。

「審判不在」がもたらす3つの弊害

格付け機関の不在は、抽象的な問題ではありません。日本企業のAI導入の現場で、具体的な弊害を生み出しています。

弊害1:「声の大きいベンダー」が勝つ

独立した評価基準がなければ、企業は何を頼りにAIツールを選ぶのか。答えは明快です。マーケティング力の強いベンダーの製品が選ばれます。

営業資料が洗練されている。導入事例が豊富に掲載されている。カンファレンスで登壇している。メディアに頻繁に取り上げられている。これらは製品の本質的な品質とは無関係ですが、評価基準がない以上、買い手はこれらの「シグナル」に頼るしかありません。

結果として、技術的には優れているが営業力の弱い中小ベンダーは埋もれ、大手の知名度だけで選定が行われる。市場の健全な競争が阻害されます。

弊害2:「導入したけど使えない」の連鎖

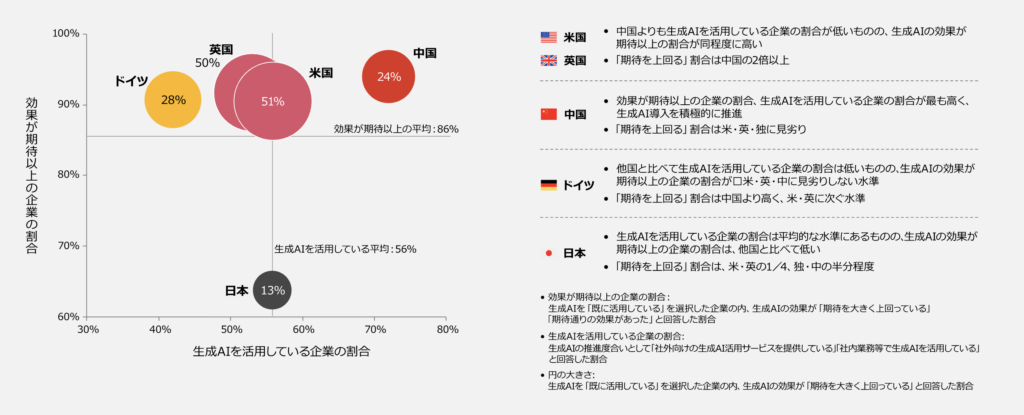

PwCの2025年調査が突きつけた日本企業の現実——生成AIの効果が「期待を上回る」と回答した企業はわずか13%。「期待を下回る」企業は増加の一途。

この数字の背景には、導入前の期待値と実際の性能の乖離があります。そして、その乖離を事前に検証する仕組みがないことが、問題の根本原因の一つです。

ベンダーのデモで見た性能を信じて導入し、実運用で期待通りにいかない。すると組織は「AIは使えない」という学習をしてしまいます。次のAI案件が提案されても「前回も失敗した」と拒否反応が出る。日本企業のAI活用が進まない原因の一端は、この「失敗体験の連鎖」にあります。

独立した事前評価があれば、「このツールは、あなたの業務環境では期待通りの性能が出ない可能性が高い」というフィードバックを導入前に得ることができます。それは「AI導入を止める」ためではなく、「正しい期待値で、正しいツールを選ぶ」ためです。

弊害3:ベンダー依存(ロックイン)の深刻化

評価基準がないということは、比較が困難ということです。いったん導入したAIツールから別のツールに乗り換えたくても、乗り換え先の性能を客観的に評価する方法がない。加えて、導入済みツールにデータが蓄積されれば、スイッチングコストは時間の経過とともに増大します。

結果として、最初の選定で入り込んだベンダーの製品を使い続けるしかなくなる。ベンダーが値上げしても、サポート品質が低下しても、より良い代替製品が市場に登場しても、乗り換えの判断ができない。

「比較できない」ことが、「逃げられない」ことにつながっている。

これは買い手にとって不利なだけでなく、市場全体の効率性を低下させます。より良い製品を開発したベンダーが正当に報われない市場では、イノベーションのインセンティブが削がれます。

他国の動き——日本だけが取り残されている

世界に目を向ければ、AIの評価と規制に関する動きは加速しています。

米国では、2025年にFTC(連邦取引委員会)がAIツールのミスリーディングな性能表示に対して実際に行政処分を下しました。NIST(国立標準技術研究所)は「AI Risk Management Framework」を策定し、AIシステムのリスク評価に関する標準的なフレームワークを提供しています。2025年にはISO/IEC 42006も発行され、AI管理システムの認証に携わる監査機関の力量基準が国際標準として定められました。

欧州では、EU AI Act(AI規制法)が段階的に施行されており、高リスクAIシステムに対しては適合性評価(第三者認証を含む)が義務化される方向に進んでいます。

翻って日本はどうか。総務省の「AI利活用ガイドライン」や経済産業省の「AI原則」は存在しますが、いずれもソフトロー(法的拘束力のないガイドライン)に留まっています。AIツールの性能表示に関する規制もなければ、第三者評価を促進する制度もありません。

日本企業が年間1兆円以上を投じるAIツール市場は、世界で最も「買い手保護」の仕組みが薄い市場の一つです。

Aixisは、なぜ存在するのか

ここまでの議論を読んで、違和感を覚えた方もいるかもしれません。「お前は結局、自分の会社の宣伝がしたいだけだろう」と。

正直に答えます。半分はその通りです。

Aixisは営利機関です。第三者監査というサービスを提供し、そこから収益を得ています。その事実を隠すつもりはありません。

しかし同時に、本稿で述べた問題意識はAixisを設立する以前から、いや、Aixisを設立した理由そのものです。

100を超えるAIツールを検証する中で、私が繰り返し目にしてきたのは次のような光景です。

ベンダーの営業資料に書かれた「精度95%」を信じて導入を決めた企業が、実運用で60%台の性能に直面して途方に暮れる。しかし、導入を推進した担当者は「失敗」を認められず、惰性で使い続ける。あるいは静かにプロジェクトが消滅する。そしてベンダーは、次の顧客に同じ営業資料を持って向かう。

この構造を変えるために必要なのは、「売り手でも買い手でもない、第三者」の存在です。

Aixisの収益構造は、意図的に「買い手側からのみ」に設計されています。AIツールベンダーから対価を受け取ることは一切ありません。ベンダーとのパートナーシップ契約もありません。認定制度やシール制度も運営していません。これらはすべて、評価の独立性を構造的に担保するための設計です。

JNCAPが自動車を身分を隠して購入するように、Aixisはあなたの会社の業務データで、あなたの会社の環境で、AIツールの実性能を測定します。ベンダーが提示しない情報——精度の分散、エッジケースでの挙動、モデルドリフトのリスク、運用コストの全体像——を明らかにします。

自動車に安全評価があるように、金融商品に格付けがあるように、AIツールにも独立した評価が必要です。

Aixisはその空白を埋めるために存在しています。

行動への呼びかけ——「あなたの会社」から変えられる

最後に、一つだけ伝えたいことがあります。

本稿で述べた構造的問題——格付け機関の不在、情報の非対称性、買い手保護の欠如——は、業界全体の問題であり、一企業が明日解決できるものではありません。

しかし、あなたの会社のAI投資を守ることは、今日からできます。

もしあなたがこれからAIツールの導入を検討しているなら、あるいはすでに導入したAIツールの効果に疑問を感じているなら。ベンダーの営業資料にある数字を鵜呑みにせず、「この数字は、うちの環境でも再現されるのか?」と問うてください。

そして、その問いに答えられる第三者を探してください。それがAixisであれば嬉しいですが、Aixisでなくても構いません。重要なのは、「売り手以外の誰か」に検証させるという文化を、日本企業が持つことです。

1兆円市場に審判を。

その第一歩は、あなたの次のAI投資から始まります。

→ AI投資の「セカンドオピニオン」を取る:Aixis 監査サービス

出典・参考文献

- IDC Japan「国内AIシステム市場予測」(2025年5月1日発表):2024年実績 1兆3,412億円、2029年予測 4兆1,873億円

- 総務省「令和7年版 情報通信白書:AIの動向 — 市場概況」

- PwC Japan グループ「生成AIに関する実態調査2025 春 5カ国比較」

- PwC Japan グループ「生成AIに関する実態調査2024 春 米国との比較」

- 独立行政法人 自動車事故対策機構(NASVA)「自動車アセスメントのご案内」

- 国土交通省「自動車アセスメント(JNCAP)」

- U.S. Federal Trade Commission “FTC Order Requires Workado to Back Up Artificial Intelligence Detection Claims”(2025年4月)

- NIST AI Risk Management Framework (AI RMF 1.0) / Generative AI Profile (2024)

- ISO/IEC 42006:2025 — Information technology — Artificial intelligence — Requirements for bodies providing audit and certification of artificial intelligence management systems

- 富士キメラ総研「2025 生成AI/LLMで飛躍するAI市場総調査」