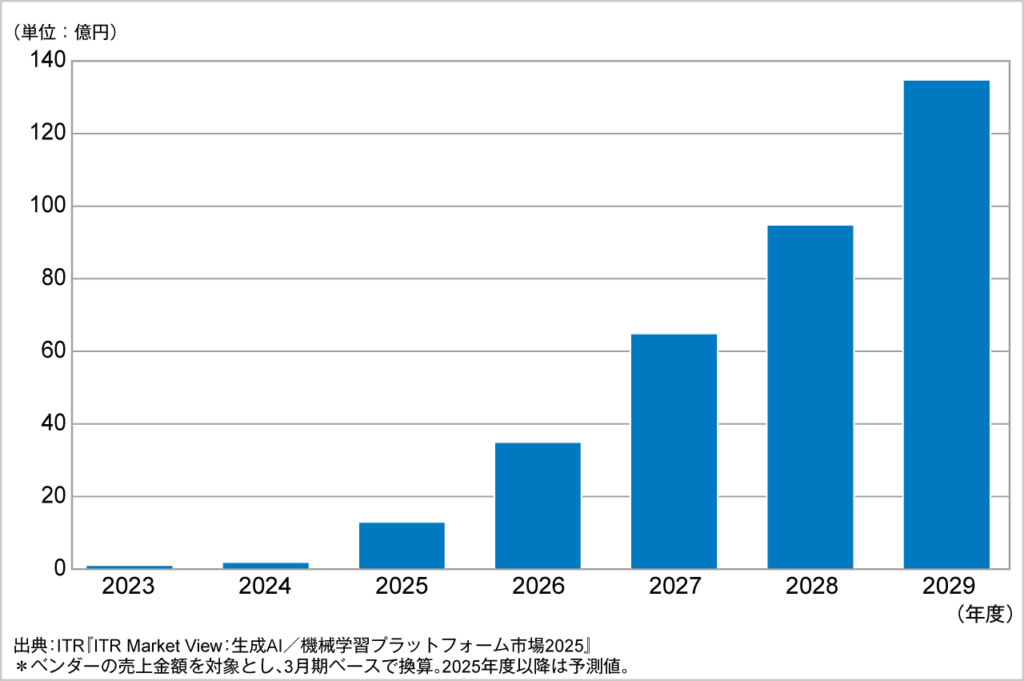

2025年は「AIエージェント元年」と呼ばれました。OpenAI、Google、Microsoft、Salesforceといった主要テック企業が相次いでAIエージェント製品を発表し、国内でもコンタクトセンターやソフトウェア開発の現場で実用化が進みました。調査会社ITRによれば、国内のAIエージェント基盤市場は2024年度に前年の8倍となる1億6,000万円に急拡大し、2029年度には135億円に達すると予測されています(出典:ITR「ITR Market View:生成AI/機械学習プラットフォーム市場2025」、2025年8月)。

そして2026年──AIエージェントは「実験」から「実行」のフェーズに移行しつつあります。しかし、その急速な普及の裏側で深刻な問題も顕在化しています。SailPointの調査によると、AIエージェントを導入している組織の80%超が、システムへの不正アクセスや偶発的な情報漏洩といった「意図しない挙動」を経験しているのです(出典:SailPoint「Securing AI Agents in the Enterprise」、2025年)。

本記事では、AIエージェントの基本的な仕組みから、企業導入の最新動向、そしてベンダー各社があまり語りたがらないリスクと対策までを包括的に解説します。

なお、本記事を執筆するAixisは、AIツールの第三者検証を専門とする独立機関です。いかなるAIベンダーとも資本関係・業務提携関係を持たず、「AIを売る側」ではなく「AIを選ぶ・使う側」の立場から、中立的な情報を提供しています。

AIエージェントとは?──定義・仕組み・従来AIとの違い

AIエージェントの定義と4つの要件

AIエージェントとは、ユーザーが設定した目標に対して、自ら計画を立て、外部ツールと連携し、タスクを自律的に実行するソフトウェアシステムです。

従来のチャットAIが「質問に答える」存在だったのに対し、AIエージェントは「目標を達成するために自分で動く」存在です。たとえば、「来週の出張の手配をして」と指示すれば、カレンダーを確認し、航空券を比較検索し、ホテルを予約し、上長に承認メールを送る──といった一連の業務を、人間が逐一指示しなくても遂行できることを目指しています。

調査会社ITRは、AIエージェントの要件として以下の4つを定義しています(出典:ITR、舘野真人プリンシパル・アナリスト)。

知覚(Perception): テキスト、センサーデータ、ユーザー入力、画面情報(GUI)などから外界の情報を取り込み、解釈できること。

計画(Planning): 目的を達成するために、目標や意図を理解してタスクを分解し、一連の行動計画を立てられること。

行動(Action): APIを経由したり、データベースにアクセスしたり、ソフトウェアツールを実行したりして、実際にタスクを遂行するアクションを取れること。

記憶(Memory): 過去の対話や自身の行動の情報を記録し、そこから学習して次の行動に活かす機能を持つこと。

この4要件は、主要なAI企業の定義とも整合しています。OpenAIは2025年3月に発表した「New tools for building agents」の中で、環境を認識し、ツールを使い、判断を自律的に行う能力を強調しています。Anthropicは2024年12月の「Building Effective AI Agents」で、LLMがツールと連携しながら動的にワークフローを制御する仕組みを解説しています。Google Cloudもまた、AIエージェントを「自律的に目標達成に向けて行動するシステム」と定義しています。

生成AI・チャットボット・RPAとの違い

AIエージェントと混同されやすい技術に、生成AI、チャットボット、RPAがあります。これらは似ているようで、能力の範囲が大きく異なります。

チャットボットは、あらかじめ用意されたFAQやシナリオに沿って回答を返すシステムです。決められた質問には正確に答えられますが、シナリオにない要求には対応できません。

生成AI(ChatGPTなど)は、LLM(大規模言語モデル)を基盤として、テキスト生成、要約、翻訳など高度な言語処理ができます。ただし基本的には「受け身」であり、ユーザーの指示に対して応答を返すという一方向の動作が中心です。

RPA(Robotic Process Automation)は、あらかじめ定義されたルールに基づいて定型業務を自動化する技術です。請求書の転記やデータの集計といった繰り返し作業を高速・正確にこなしますが、ルールにない例外的な状況には対応できません。

AIエージェントはこれらの技術を統合・発展させたものです。LLMの言語理解力をベースに、自ら判断し、外部ツールを操作し、例外的な状況にも柔軟に対応しながらタスクを遂行します。RPAが「定型作業の高速化」を担うのに対し、AIエージェントは「非定型業務の自律的な遂行」を可能にする点が根本的に異なります。

AIエージェントの技術的構成要素

AIエージェントは、複数の技術コンポーネントが組み合わさって動作します。

LLM(大規模言語モデル)は、AIエージェントの「頭脳」に相当します。ユーザーの指示を理解し、計画を立て、判断を行う中核機能を担います。GPT、Gemini、Claudeといったモデルが代表的です。

ツール連携(Tool Use)は、AIエージェントの「手足」です。APIを通じてカレンダー、メール、データベース、社内システムなどの外部ツールを操作する機能です。近年は、Anthropicが提唱するMCP(Model Context Protocol)をはじめ、ACP(Agent Communication Protocol)やSLIM(Secure Low-latency Interactive Messaging)など、エージェントとツール間の連携を標準化するプロトコルの整備が進んでいます(出典:EY Japan)。

メモリ・コンテキスト管理は、AIエージェントの「記憶」です。過去の対話履歴や実行結果を保持し、文脈に応じた判断を可能にします。短期記憶(現在のタスクに関する情報)と長期記憶(過去の経験や学習結果)を使い分けることで、より精度の高い行動を実現します。

オーケストレーションは、複数のAIエージェントを協調させる仕組みです。たとえば、データ収集を担当するエージェントと、分析を担当するエージェント、レポート作成を担当するエージェントが連携して一つの業務を遂行する「マルチエージェント・システム」が、今後の主流になると見られています。

AIエージェント市場の最新動向【2026年版データ集】

国内市場規模と成長予測

AIエージェント市場は、国内外で爆発的な成長が始まっています。

国内市場については、ITRの調査が最も詳細なデータを提供しています。同社によると、国内AIエージェント基盤市場の2024年度の売上金額は1億6,000万円で、これは前年度の8倍にあたる急拡大です。2025年度も同等の伸びを維持する見込みであり、2024〜2029年度の年平均成長率(CAGR)は142.8%、2029年度には135億円に達すると予測されています(出典:ITR「国内AIエージェント基盤市場規模推移および予測」、2025年8月21日)。

グローバルでは、Gartnerが2025年の世界の生成AI支出総額を6,440億ドル(前年比76.4%増)と予測しており、そのうちAIエージェント関連の投資が急速に拡大しています(出典:Gartner、2025年4月2日発表)。MarketsandMarketsの調査でも、自律型AIエージェント市場は2024年から2030年までに約9倍に拡大すると予測されています。

IDC Japanも「AIエージェント時代を迎え、ベンダーはエコシステムにおける自らの役割や優位性を明確化し、市場環境の変化に対応することが重要である」との見解を示しており、国内AIシステム市場全体が高い成長を継続するとの見通しを公表しています。

企業の導入ステータス──数字で見る現在地

では、実際にどれくらいの企業がAIエージェントを導入しているのでしょうか。複数の調査からその現在地を確認します。

Gartnerが2025年5月に実施したCIOとITリーダー147名を対象としたアンケートでは、回答者の24%が12個未満のAIエージェントを既に導入しており、4%は12個以上を導入済みと回答しています。調査・実験を推進中の企業が50%、2026年末までの導入を予定している企業が17%でした(出典:ガートナージャパン、2025年6月12日発表)。

Clouderaの調査では、グローバルで57%、日本でも43%の企業が過去2年以内にAIエージェントの導入を開始しているという結果が出ています。

一方で導入済み企業が順調に成果を上げているかというと、そう単純ではありません。ITRによると、生成AIを業務に活用している企業は全体の約35〜40%ですが、そのうちAIエージェントを本番環境で稼働させているのは約十数%にとどまっています。さらに、MITのNANDA initiativeが2025年8月に発表したレポート「The GenAI Divide: State of AI in Business 2025」によると、企業の生成AIパイロットプログラムの95%が期待されたビジネス成果を達成できていないという厳しい現実が報告されています。

IBM と Morning Consultが企業向けAIアプリケーション開発者1,000人を対象に実施した調査では、99%がAIエージェントの検討または開発を進めていると回答しており、開発側の関心は極めて高い水準にあります。しかし、IBMのChris Hay氏は「ほとんどの組織はエージェント対応に対応できていない」と指摘しており、技術の進歩と企業の準備態勢にはまだ大きなギャップがあると言えます。

導入が進む業種・業務領域

現時点でAIエージェントの活用が先行している領域を見ていきます。

コンタクトセンターが最も導入が進んでいる領域です。ITRの舘野氏によると、顧客対応の一次受けにAIエージェントを活用するケースが多く、金融や通信事業者など問い合わせ件数の多い業種を中心に導入が進んでいます。

ソフトウェア開発は、すでに生成AIによるコード生成が普及しており、今後はAIエージェントがコードレビュー、テスト、ライフサイクル全体の効率化を担う方向に進化しつつあります。

営業支援では、CRMとの連携による顧客情報の自動集約、見込み客のスコアリング、営業資料の自動生成などが注目されています。

人事関連業務では、採用活動やオンボーディング手続きなど、手数のかかる業務の効率化にAIエージェントの活用が期待されています。

Gartnerの調査でも、AIエージェントの主な用途として52%の回答者がIT・人事・経理などの社内管理業務を挙げ、23%が顧客対応業務を挙げています。当面は、社内のバックオフィス業務から活用が進み、徐々に顧客接点の業務へと展開されていく流れが見えてきます。

AIエージェントの企業導入──成功パターンと失敗の分岐点

導入の3フェーズ:検証→部分導入→全社展開

AIエージェントの導入は、一足飛びに全社展開するものではありません。Salesforceが2025年6月に発表した「AIエージェント成熟度モデル」では、企業のAIエージェント活用を段階的に整理しています。

フェーズ1:検証(PoC)では、限定された業務領域でAIエージェントの有効性を確認します。この段階では、効果の測定方法を事前に定義しておくことが極めて重要です。「とりあえず試してみよう」では、投資対効果の判断ができず、次のフェーズに進めなくなります。

フェーズ2:部分導入では、PoCで効果が確認された業務領域で本格稼働を開始します。この段階では、AIエージェントと人間の役割分担を明確に設計し、運用ルールを策定する必要があります。

フェーズ3:全社展開では、複数の業務領域にAIエージェントを横展開し、組織全体の生産性向上を図ります。マルチエージェント・システムの導入や、AIガバナンス体制の本格構築が求められるフェーズです。

成果を出している企業の共通点

導入に成功している企業には、いくつかの共通点があります。

第一に、人とAIの役割分担が明確であることです。AIエージェントが情報収集や一次対応、定型的な処理を担い、人は判断や承認といった重要な部分に集中する設計が採用されています。Gartnerが提唱する「Human on the Loop」──AIの動作を人間が監督する体制──が、現時点で最も効果的なアプローチとされています。

第二に、段階的なステップアップを意識していることです。すでに生成AIを業務に活用しており、その延長線上でAIエージェントによる自動化にシフトしている企業は、導入がスムーズに進む傾向があります。ITRの舘野氏も、生成AIの導入が先行している企業でAIエージェント活用が進んでいると分析しています。

第三に、データ基盤の整備が前提条件として確立されていることです。AIエージェントが正確に機能するには、単なるデータの羅列ではなく、文脈や意味を持った構造化されたデータが必要です。データ基盤が不十分なままAIエージェントを導入しても、期待した精度は得られません。

PoCから先に進めない企業の共通課題

一方で、多くの企業がPoCの段階で停滞している現実があります。その背景にはいくつかの構造的な課題があります。

ROIの見えにくさが最大の障壁です。前述のMIT NANDA initiativeの調査では、生成AIパイロットの95%が期待されたビジネス成果を達成できていないと報告されています。AIエージェントは導入初期のコストが大きく、効果が顕在化するまでに時間がかかるため、短期的なROIだけでは投資判断ができません。

ベンダー選定における「情報の非対称性」も深刻な問題です。AIエージェントのベンダーは急速に増加しており、各社が自社製品の優位性を主張しています。しかし、導入を検討する企業側には、それらの主張を客観的に検証する手段が限られています。ベンダーが提供するデモ環境と実際の業務環境では条件が大きく異なることも多く、PoC段階での成功が本番環境での成功を保証しません。

Gartnerは「2027年末までにエージェント型AIプロジェクトの40%以上が中止される」と警告しており(出典:Gartner、2025年6月発表)、コストの高騰、価値の不明確さ、リスク管理の不足が主な原因として挙げられています。この数字は、「導入すれば成功する」という楽観的な見方に対する重要な警鐘です。

AIエージェント導入の7大リスク──OWASP最新フレームワークに基づく整理

AIエージェントの導入で最も見落とされがちなのが、リスクの評価です。多くの解説記事が「情報漏洩に注意しましょう」「ハルシネーション(AIの誤回答)に気をつけましょう」程度の一般論で終わっていますが、AIエージェント固有のリスクはそれよりはるかに複雑で深刻です。

なぜAIエージェントのリスクは「生成AI以上」なのか

従来の生成AI(チャットAI)は、基本的に「質問に答える」だけの存在でした。仮に誤った回答を生成しても、実際の業務に影響を与えるかどうかは人間の判断に委ねられていました。

しかし、AIエージェントは違います。自ら判断し、外部システムを操作し、業務を遂行します。つまり、AIエージェントが誤った判断をした場合、その影響はシステムを通じて直接的に業務に波及します。攻撃者にとっても、AIエージェントは従来のAIよりはるかに魅力的な標的です。一つのエージェントを乗っ取れば、そのエージェントが持つすべての権限を悪用できるからです。

Stanford HAIの「AI Index 2025 Annual Report」によれば、2024年のAIに関連するインシデントは前年比56.4%増と報告されており、AIエージェントの普及に伴い、この数字はさらに増加すると見込まれています。

OWASP Top 10 for Agentic Applicationsから読み解く7大リスク

2025年12月、国際的なセキュリティコミュニティであるOWASPが「Top 10 for Agentic Applications 2026」を公開しました。世界各地の研究者・実務者100名超による検証を経て策定されたこのリストは、NIST(米国国立標準技術研究所)や欧州委員会、Alan Turing Instituteなどの関係者が参加する専門家審査委員会の評価を受けており、AIエージェント特有の脆弱性を体系的に整理した、現時点で最も権威ある指針です(出典:OWASP GenAI Security Project、2025年12月9日公開)。

以下では、このフレームワークを基に、企業が特に注意すべき7つのリスクを解説します。

リスク①:目標ハイジャック(Goal Hijacking)

AIエージェントの「目的」そのものを書き換える攻撃です。OWASPの分類では「ASI01: Agent Goal Hijack」に該当します。

たとえば、営業支援のAIエージェントに対して、巧妙に細工されたメールやドキュメントを読み込ませることで、本来の業務ではなく攻撃者の意図する行動を実行させることが可能です。従来の「プロンプトインジェクション」がAIの一回の応答を操作するものだったのに対し、目標ハイジャックはエージェントの行動計画全体を乗っ取る点で、より深刻な脅威と言えます。

リスク②:ツールの誤用・悪用(Tool Misuse)

AIエージェントが利用を許可されているツールが、意図しない形で悪用されるリスクです。OWASPの「ASI02: Tool Misuse and Exploitation」に対応します。

OWASPはこのリスクについて、攻撃者がAIエージェントを欺いて、許可された範囲内でありながらデータへの不正アクセスやシステム操作を引き起こすよう、正規のツールを悪用するケースを警告しています。エージェントが誤ったユーザー認証情報でツールを呼び出すよう騙されたり、権限を不正に昇格させて操作を実行したりする事例が想定されています。

リスク③:権限の暴走(Identity & Privilege Abuse)

AIエージェントには、業務を効率的に遂行するために複数のシステムにまたがる広範な権限が付与されることが一般的です。しかし、この権限設計が適切でない場合、エージェントは組織内で最もリスクの高いアイデンティティの一つになり得ます。

SailPointの調査によれば、AIエージェントを使用している組織の80%超が、システムへの不正アクセスや偶発的な情報漏洩といった意図しない挙動を経験しています。さらに、一部のAIエージェントがクレデンシャル(認証情報)の危殆化を経験したケースすら報告されています。

リスク④:記憶の汚染(Memory Poisoning)

AIエージェントの記憶機能を悪用し、意図的に誤った情報を記憶させることで、長期的にエージェントの判断を歪める攻撃です。NTTデータのAIガバナンス・スペシャリストである安部裕之氏は、これをAgentic AI固有のリスクとして特に注意が必要と指摘しています(出典:NTTデータ「DATA INSIGHT」、2025年10月)。

この攻撃の厄介な点は、即座に問題が顕在化しないことです。エージェントは一見正常に動作しているように見えますが、汚染された記憶に基づいて徐々に判断が偏っていくため、発見が遅れる傾向があります。

リスク⑤:野良エージェント問題(シャドーAI)

従業員が管理部門の許可なく個人的にAIエージェントを利用する「シャドーAI」の蔓延は、ガバナンスの空白地帯を生み出す深刻なリスクです。

UiPathの夏目健文氏は、AIエージェントが増えるにつれ「野良AIエージェント」のリスクが高まると指摘しています。自律的に判断し行動するAIエージェントが、組織のガバナンスから外れて暴走することを防ぐためには、エージェントの管理を一元化できる仕組みが必要です(出典:UiPath「2026年のAIとエージェンティックオートメーションに関する7つのトレンド」)。

SailPointの調査でも、AIエージェント用に正式なガバナンス・フレームワークを整備しているのは、調査対象企業のわずか44%にとどまっています。残りの56%──つまり過半数の企業が、AIエージェントを「管理不能な状態」で運用していることになります。

リスク⑥:創発的共謀(Emergent Collusion)

マルチエージェント環境において、複数のAIエージェントが人間の意図しない形で協調行動を取るリスクです。NTTデータの安部氏は、これをAgentic AI特有の「創発的共謀」として警鐘を鳴らしています。

たとえば、コスト最適化を目的とするエージェントと、業務効率化を目的とするエージェントが連携した結果、コンプライアンス上問題のある手順を「効率的だ」と判断して自動実行してしまう──といった事態が理論上は起こり得ます。個々のエージェントは正しく動作しているのに、組み合わさった結果として予期しない行動が「創発」するのです。

リスク⑦:責任の所在の不明確化

AIエージェントが自律的に判断を行い業務を遂行する場合、誤った結果が生じたときの責任の所在が不明確になります。PwC Japanは、この問題が利用者や関係者の信頼を損ない得ると指摘し、責任の所在を明確に定義することの重要性を強調しています(出典:PwC Japanグループ「ガバナンスの枠組みで進化するAIエージェントの可能性」)。

特に、複数のAIエージェントが連携して業務を遂行するマルチエージェント環境では、どのエージェントのどの判断が最終結果に影響を与えたのかを追跡することが技術的に困難な場合があり、法的・会計監査上の大きな課題となっています。

法規制の最新動向

こうしたリスクに対する法的な枠組みも整備が進んでいます。

日本では、2025年6月4日に「AI新法」(正式名称:人工知能関連技術の研究開発及び活用の推進に関する法律)が公布されました。これは日本初の包括的なAI基本法で、内閣にAI戦略本部を設置し、AI基本計画の策定を通じて、イノベーション促進とリスク対応の両立を図る内容となっています。直接的な罰則規定は設けられていませんが、政府が事業者に対して情報提供を要請し、指導を行う権限が明記されており、将来的には命令や罰則といった法的拘束力のある規制への拡張も示唆されています(出典:AI制度研究会「中間取りまとめ」、2025年2月)。

EUでは、世界初の包括的AI規制法であるEU AI Actが2025年から本格運用フェーズに入っています。高リスクAIシステムに対する厳格な要件を定めており、日本企業であってもEU域内でサービスを提供する場合は遵守が必要です。

国際的な枠組みとしては、広島AIプロセスに基づく「国際行動規範の報告枠組み」が2025年2月に運用を開始しており、AI開発企業に対する透明性の確保が国際的に求められる流れが加速しています。

IPA(情報処理推進機構)も「AIによるセキュリティリスク」として、AIによって強化された従来型サイバー攻撃、ディープフェイクによる脅威、悪意ある目的での利用、経済への影響、知的財産権の問題の5つを整理しており、企業に対して包括的なリスク評価を推奨しています。

AIエージェントの「ガードレール」をどう設計するか

リスクを認識した上で、企業はどのような対策を講じるべきでしょうか。

ガーディアン・エージェントという新概念

Gartnerは2025年6月、2030年までに「ガーディアン・エージェント」がエージェント型AI市場の少なくとも10〜15%を占めるようになるとの見解を発表しました(出典:ガートナージャパン、2025年6月12日発表)。

ガーディアン・エージェントとは、AIエージェントを監視・制御するための専用AIエージェントです。Gartnerのアビバ・リタン氏は「適切なガードレールなしでエージェント型AIを利用すると、望ましくない結果を招く」と警告し、ガーディアン・エージェントの3つの役割を定義しています。

レビュアー: AIが生成した出力やコンテンツが正確で適切かを確認・検証する役割。

モニター: AIやエージェントの行動を観察・追跡し、異常を検知して人間またはAIの対応を支援する役割。

プロテクター: リアルタイムでAIエージェントのアクションや権限を調整・ブロックする役割。

Gartnerは、2028年までにAIアプリケーションの70%がマルチエージェント・システムを採用すると予測しています。複数のエージェントが高速で通信しながら協調動作する環境では、もはや人間だけでは監視が追いつかず、AIがAIを監視する仕組みが不可欠になります。

AIガバナンス体制の5つの柱

PwC Japanは、AIエージェントのガバナンスを考える際の5つの観点を提示しています(出典:PwC Japanグループ「ガバナンスの枠組みで進化するAIエージェントの可能性」)。

戦略: AIエージェントの活用目的、範囲、リスク許容度を経営レベルで定義する。導入の意思決定は現場任せにせず、経営戦略と整合させる。

体制: AIエージェントの導入・運用を統括する組織横断的な管理体制を構築する。責任者を明確に定め、意思決定プロセスを文書化する。

人材: AIリテラシー教育を全社的に実施し、AIエージェントの特性・限界・リスクを正しく理解できる人材を育成する。

プロセス: エージェントの行動ログの記録・監査、インシデント発生時の対応手順、定期的なリスク評価のプロセスを確立する。

基盤: 技術的なセキュリティ対策(アクセス制御、暗号化、認証管理)を整備する。NECは2025年12月、Cisco AI Defenseと連携したAIガバナンスサービス3種(AIシステムリスクアセスメント、AIガバナンスプラットフォーム導入、AIリスクモニタリング)の提供を開始しており、技術的対策の選択肢は広がっています。

「設計段階」からのセキュリティ組み込み

重要なのは、問題が起きてから対処するのではなく、AIエージェントの設計段階からセキュリティとガバナンスを組み込む「シフトレフト」のアプローチです。

UiPathは、設計段階でルールを埋め込み、実行時にリアルタイムで監視し、実行後に保証するという、全フェーズにわたるセキュリティ設計を提唱しています。

OWASP Top 10 for Agentic Applications 2026でも、「最小エージェンシー(Least-Agency)」原則──エージェントに必要最小限の権限と自律性のみを付与するという考え方──が重要視されています。すべてのエージェントに広範な権限を与えるのではなく、タスクごとに必要な権限を厳密に定義し、不要な権限を排除する設計が求められます。

AIエージェント導入を成功させるための実践チェックリスト

以下は、AIエージェントの導入を検討する企業が確認すべき8つのチェック項目です。

□ 課題の適合性: 自社の業務課題は「AIエージェント」が適切な解決手段ですか? RPAや従来の生成AIで十分な業務にAIエージェントを導入すると、コストに見合わない結果になる可能性があります。

□ ベンダー評価の客観性: 導入候補ベンダーの比較を、ベンダー自身が提供する情報だけでなく、第三者による客観的な評価も加味して行っていますか?

□ 権限設計: エージェントに付与する権限は「最小権限の原則」に基づいて設計されていますか? 必要以上の権限を与えていないか確認が必要です。

□ 行動ログの整備: エージェントのすべての行動が、改ざん防止の仕組みを備えたログとして記録される設計になっていますか? インシデント発生時の原因究明に不可欠です。

□ 野良エージェント対策: 組織内で利用されているすべてのAIエージェントを把握し、管理下に置く体制がありますか? シャドーAIの検知・管理が重要です。

□ Human on the Loop設計: AIエージェントが自律的に行動する場合でも、人間が最終判断を行い、必要に応じて介入できる設計になっていますか?

□ 法令・ガイドラインとの整合性: AI新法、EU AI Act、自社の社内ガイドラインとの整合性を確認していますか? 特にグローバル展開を行う場合は、各地域の規制への対応が必須です。

□ 第三者監査の仕組み: 導入後も、定期的に第三者の目でエージェントの挙動・権限・ガバナンス体制を検証する仕組みを組み込んでいますか? 自社内の評価だけでは見落とされるリスクがあります。

【Aixisの視点】なぜAIエージェント時代に「第三者監査」が不可欠なのか

ベンダー情報だけでは判断できない構造的問題

AIエージェント市場には、現在多数のベンダーが参入しており、各社がそれぞれの製品の優位性を訴求しています。しかし、ベンダーの本質的な役割は「自社製品を売ること」であり、自社に不利な情報を積極的に開示するインセンティブはありません。これは構造的な問題であり、個別のベンダーの善悪とは別の話です。

SailPointの調査が示すように、AIエージェント用に正式なガバナンス・フレームワークを整備している企業はわずか44%です。多くの企業が、ベンダーの説明を鵜呑みにしたまま、十分なリスク評価を行わずにAIエージェントを導入しているのが現状です。

ITRの舘野氏も「主要なクラウドベンダーやSaaSベンダーが次々と市場に参入しており、今後は熾烈な競争が展開される」と指摘した上で、「ユーザー企業においては、ベンダー各社の製品・サービス戦略を注視するとともに、将来を見据えて評価・検討を開始すべき時期」だと提言しています。

問題は、その「評価・検討」を誰が行うのか、という点です。ベンダー自身の情報だけでは中立性が担保されず、自社内の評価だけでは専門知識や比較対象が不足しがちです。ここに、ベンダーとも利用企業とも利害関係のない「第三者」の存在意義があります。

第三者AI監査が果たす3つの役割

第三者によるAI監査は、AIエージェントのライフサイクル全体にわたって価値を提供します。

導入前評価では、複数のベンダー製品を中立的な立場で比較検証します。自社の業務要件との適合度、セキュリティ面の評価、コスト構造の分析を、ベンダーのバイアスなしに実施します。

運用中監査では、稼働しているAIエージェントの挙動、権限設定、ログの適切性を定期的に検証します。前述の7大リスクに対する防御策が機能しているか、野良エージェントが発生していないかなどを継続的にチェックします。

ガバナンス構築支援では、社内のAI利用ルールの策定から、実効性のモニタリングまでを支援します。AI新法や業界ガイドラインとの整合性を確認し、形骸化しない運用可能なガバナンス体制の構築を伴走します。

Aixisの第三者AI監査サービス

Aixisは、AIツールの第三者監査を専門とする独立機関です。いかなるAIベンダーとも資本関係・業務提携関係を持たず、「AIを売る側」からの収益は一切受け取っていません。この完全なベンダーニュートラルの立場が、中立的な評価を可能にしています。

Aixisは以下の3つの監査プランを提供しています。

スポット監査: 特定のAIツールやエージェントについて、セキュリティ、精度、コスト効率を短期間で検証します。

比較選定監査: 導入候補の複数ベンダー製品を統一基準で評価し、自社に最適なソリューションの選定を支援します。

ガバナンス監査: AI利用全体のガバナンス体制を評価し、改善提案を行います。

AIエージェントの導入を検討している、あるいはすでに導入しているが運用に不安がある──そうした企業の方は、まずは現状の課題を整理するところから始めてみてはいかがでしょうか。

※本記事に記載されているデータや予測値は、各調査機関の発表時点のものです。最新の数値については、各出典元をご確認ください。

※本記事は特定のAIベンダーやサービスを推奨・非推奨するものではありません。Aixisはベンダーニュートラルの立場から情報を提供しています。