「AIを導入したのに、まったく使われていない」「PoC(概念実証)までは順調だったのに、本番導入が進まない」——こうした声を、AI導入の現場で耳にする機会が増えています。

2025年7月、MIT(マサチューセッツ工科大学)が発表した調査レポート「The GenAI Divide: State of AI in Business 2025」は、世界中の企業に衝撃を与えました。300件以上のAIプロジェクトを分析した結果、企業のAI導入プロジェクトのうち実に95%が、測定可能なリターンを生み出せていないことが明らかになったのです。全世界で300〜400億ドルもの投資が行われているにもかかわらず、そのほとんどが期待した成果に結びついていません。

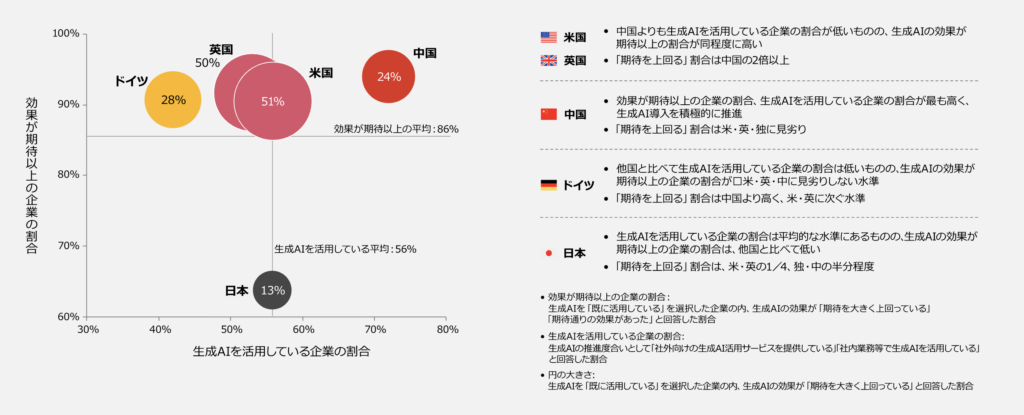

日本企業の状況は、さらに深刻です。PwC Japanグループが2025年6月に発表した「生成AIに関する実態調査2025春 5カ国比較」によれば、生成AIの効果が「期待を上回っている」と回答した日本企業の割合は約10%にとどまり、米国(約45%)・英国の約4分の1、ドイツ・中国の約半分という結果でした。導入率自体は他国と同水準に達しているにもかかわらず、効果を刈り取れていない——これが日本企業のAI導入の現実です。

しかし、裏を返せば、これらの失敗パターンを事前に知り、対策を講じることで失敗を回避できるということでもあります。

本記事では、国内外の調査データと、Aixisがこれまでに実施してきた100件以上のAIツール検証の知見をもとに、AI導入で頻出する失敗パターンを20個に体系化しました。自社のAI導入プロジェクトを「失敗する95%」から「成功する5%」の側に導くための実践ガイドとしてご活用ください。

第1章:データで見る「AI導入失敗」のリアルな現実

AI導入の失敗を語るうえで、まず現状を正確に把握する必要があります。国内外の信頼性の高い調査データから、AI導入が直面している課題の全体像を確認していきましょう。

MITレポートが示した「GenAI Divide(生成AI格差)」

MIT Media Labの研究チームは、2025年1月から6月にかけて、52名の経営幹部へのインタビュー、153名のシニアリーダーへのアンケート、そして300件以上の公開AIプロジェクトの分析を実施しました。

その結果判明したのは、成果を出している企業とそうでない企業の間に生まれた深刻な格差、すなわち「GenAI Divide(生成AI格差)」の存在です。

このレポートが指摘する主要なポイントは次のとおりです。

まず、企業が開発したカスタムAIツールのうち、本番環境まで到達するのはわずか5%しかないということです。残りの95%は、パイロット段階で停滞したまま終わっています。

次に、投資配分の偏りです。生成AI予算の約50%が営業・マーケティング領域に投じられていますが、実際にROIが高いのはバックオフィス業務の自動化です。成功企業では、業務プロセスのアウトソーシングコスト削減だけで年間200万〜1,000万ドルの効果を生んでいるケースもあります。

さらに、中堅企業の方がパイロットから本番導入までの期間が約90日と短いのに対し、大企業は9カ月以上を要する傾向がある点も重要です。規模が大きいほど導入がスムーズとは限らないのです。

日本企業の効果実感は、米英の約4分の1

PwC Japanグループの5カ国比較調査は、日本企業の課題をより鮮明に浮かび上がらせました。

この調査は、売上高500億円以上の企業に所属する課長以上の管理職を対象に、日本945名、米国670名、英国412名、ドイツ103名、中国512名から回答を得たものです。

日本企業の生成AI活用状況は「社内で活用中」または「具体的な案件を推進中」を合わせると半数を超え、推進度自体は他国と同水準にあります。しかし、「期待を大きく上回る効果を得ている」と回答した日本企業は約10%にとどまりました。前年調査の9%からほぼ横ばいであり、米国が33%から45%に伸長しているのとは対照的です。

PwCは、日本企業が効果を出せていない背景として、合意形成を重視する文化、ボトムアップ志向の意思決定スタイル、失敗への過度な懸念、そして目標設定の低さとチャレンジ意識の不足を挙げています。

JUAS調査:導入は進んでも「効果測定」が追いつかない

一般社団法人日本情報システム・ユーザー協会(JUAS)が実施した「企業IT動向調査2025」でも、同様の傾向が見られます。

言語系生成AIの導入企業(準備中含む)は41.2%に達し、前年から14.3ポイントの急伸を見せました。売上高1兆円以上の企業では92.1%がすでに導入もしくは準備段階にあります。

しかし、導入効果について見ると、「期待を大きく超える効果があった」と回答した企業はわずか4.0%にとどまっています。「概ね想定どおり」が33.1%、「期待値には至っていないが一定の効果はあった」が36.1%であり、合計で約7割の企業が何らかの効果は実感しつつも、期待を大きく上回るには至っていません。

さらに重要なのは、効果測定の手法自体に課題がある点です。多くの企業が「利用者の満足度調査」や「労働時間の削減測定」で効果を評価していますが、事業インパクトとして定量化できている企業はまだ少数派です。

BCGの提言:成功のカギは「10:20:70の法則」

ボストン コンサルティング グループ(BCG)も、AI導入における成功と失敗の分水嶺について重要な知見を発表しています。

BCGが19の市場・12の業界で売上1億ドル超の企業経営者1,803名を対象に行った調査によると、経営層の75%がAIを優先事項のトップ3に位置づけている一方、実際に大きな価値を実現できたと報告したのは25%にとどまりました。

成果を上げている企業に共通するのは、「10:20:70の法則」と呼ばれるリソース配分です。投資全体の10%をアルゴリズム(AIモデルの構築・学習)に、20%をデータ・テクノロジー基盤に、そして残りの70%を人材・業務プロセス・組織カルチャーの変革に充てています。

つまり、AI導入の成否を分けるのは技術力ではなく、組織としての変革力なのです。この視点を踏まえたうえで、次章からは具体的な失敗パターン20選を見ていきましょう。

第2章:AI導入で頻出する失敗パターン20選

AI導入の失敗は、大きく「戦略の失敗」「技術選定の失敗」「組織の失敗」「運用の失敗」の4つのカテゴリーに分類できます。それぞれ5つずつ、計20の失敗パターンを解説します。

【戦略の失敗】パターン1〜5

パターン1:AI導入自体が目的になっている

最も多く、そして最も根本的な失敗パターンです。

「競合がAIを導入したから」「経営層からAI活用の指示が出たから」——こうした動機で始まるAIプロジェクトは、高い確率で成果を生みません。AI導入が「手段」ではなく「目的」にすり替わってしまうからです。

MITのレポートでも指摘されているように、成功している5%の企業に共通するのは、特定の課題(ペインポイント)にフォーカスしたアプローチです。「AIで何ができるか」ではなく「この業務課題をどう解決するか」から逆算して、その解決手段としてAIが最適かどうかを判断しています。

Aixisの検証経験でも、「とにかくAIを入れたい」という依頼は少なくありません。しかし、課題定義が曖昧なままツールを選定しても、導入後に「何を測ればいいのかわからない」という状態に陥るのがほぼ確実です。

回避策:AI導入の企画段階で「AIがなくても解決できないか?」と必ず自問してください。Excelマクロやワークフロー改善など、AIよりシンプルな手段で解決できる課題にAIを持ち込む必要はありません。

パターン2:KPI未設定のまま走り出す

「AIを導入すれば業務効率が上がるはずだ」——この漠然とした期待だけでプロジェクトを開始してしまうケースです。

JUAS調査でも明らかになっているように、多くの企業がAI導入の効果測定に課題を抱えています。効果を測れないのは、そもそも「何をもって成功とするか」を事前に定義していないからです。

KPIが設定されていないプロジェクトでは、導入後に効果が見えず、経営層から「投資対効果が不明」として予算が打ち切られるパターンが頻発します。あるいは、現場では便利に使っていても数字で示せないため、社内での展開拡大に必要な予算承認を得られないという事態に陥ります。

回避策:導入前に、定量的なKPIを必ず設定してください。たとえば「月間の書類作成時間を○時間削減」「問い合わせ対応のうち○%をAIで自動化」「○○工程のエラー率を○%低減」など、具体的な数値目標を定めましょう。また、ベースライン(導入前の現状値)を必ず計測しておくことも重要です。

パターン3:経営層のコミットメント不足

PwC Japanの調査は、成功企業と失敗企業を分ける最大の要因のひとつとして、経営層のリーダーシップの有無を明確に挙げています。

効果が期待を上回っている企業では、経営変革の目的を持った経営陣の主導のもとで生成AIが中核プロセスに統合されています。一方、効果が期待を下回っている企業では、生成AIを単なる業務効率化のツールとして断片的に導入し、推進が現場任せになっている傾向が見られます。

BCGの調査でも、一般従業員のうち「自社の経営層はAI活用に関して十分な指針を示してくれている」と感じている人はわずか25%にとどまっており、経営リーダーの関与が不十分な実態が浮き彫りになっています。

経営層が「AIは情報システム部門の仕事」「現場に任せておけばいい」と考えている限り、AI導入が全社的な成果に結びつくことはありません。

回避策:AI導入を情報システム部門や特定部署のプロジェクトとせず、経営戦略の一部として位置づけてください。経営層自身がAIツールを使い、推進状況を定期的にレビューする体制が不可欠です。

パターン4:AI=RPAの延長線と誤認する

「AIを入れれば、今の業務がそのまま自動化される」と考えるのは危険な誤解です。

RPAは定型的なルールに従って決まった作業を繰り返すことに優れています。一方、AIは非定型データの処理や予測・判断を得意としますが、既存の業務プロセスをそのまま自動化するものではありません。

この誤認が招く最大の問題は、業務プロセスの再設計を行わないまま、既存のワークフローにAIを「貼り付ける」だけで終わってしまうことです。MITのレポートでも、成功企業はAIの導入を機に業務プロセスそのものを再構築しているのに対し、失敗企業は既存の業務フローにAIを無理に組み込もうとして成果を出せていないと報告されています。

回避策:AI導入を業務プロセスの見直し機会として捉えましょう。「今の業務をどう自動化するか」ではなく、「この業務の最適なプロセスは何か」を先に考え、その中でAIが最も価値を発揮するポイントを特定するアプローチが有効です。

パターン5:競合の導入事例をそのまま真似する

「A社がAIチャットボットを導入して成功したらしい。うちも同じものを入れよう」——この発想には大きな落とし穴があります。

AI導入の成否は、業界特性、企業規模、データの蓄積状況、既存システム環境、従業員のリテラシー、そして組織カルチャーなど、無数の変数に左右されます。競合で成果を出したAIツールが自社でも同じ効果を発揮する保証はどこにもありません。

特に危険なのは、外部に公開されている導入事例が「成功事例」に偏っていることです。ベンダーの事例集やプレスリリースに掲載されるのは成功した案件がほとんどで、その裏にある多数の失敗は表に出てきません。公開情報だけを基に意思決定するのは、生存者バイアスに陥るリスクが高いと言えます。

回避策:他社事例は「参考情報」にとどめ、自社固有の課題・データ環境・業務フローに基づいてAI導入の判断を行ってください。可能であれば、ベンダーではない第三者に自社の状況を客観的に評価してもらうことをおすすめします。

【技術選定の失敗】パターン6〜10

パターン6:ベンダーの営業トークだけでツールを選定する

AI導入の失敗原因として、ツール選定段階での情報の非対称性は見過ごせない問題です。

MITのレポートの中でも、ある調達担当者が次のような趣旨のコメントを残しています。「今年だけで何十ものデモを見たが、本当に使えるのは1つか2つ。残りはラッパー(既存の技術の表面を変えただけの製品)かサイエンス・プロジェクト(実用性のない研究的取り組み)だ」と。

AIツール市場は急速に拡大しており、玉石混交の状態です。ベンダーはデモ環境で最も映える条件下でプレゼンを行うため、実際の業務データで動かしたときの精度やパフォーマンスが大きく異なるケースは珍しくありません。

Aixisの検証でも、デモでは高い精度を示していたツールが、実際のデータで検証すると期待値を大幅に下回るケースを数多く確認しています。

回避策:ベンダーのデモや営業資料だけで判断せず、自社の実データを用いたPoC(概念実証)を必ず実施してください。また、複数のベンダーを比較検討する際は、統一した評価基準を事前に策定しておくことが重要です。

パターン7:オーバースペックなツールを導入してしまう

「どうせ導入するなら、最先端の高機能なツールを」と考えるのは自然な発想ですが、これがかえって失敗を招くことがあります。

高機能なAIツールは一般的に導入コストが高く、設定やカスタマイズに時間がかかり、運用にも専門知識を必要とします。自社の課題に対して必要十分な機能を持つツールを選ぶ方が、導入スピード・定着率・費用対効果のすべてにおいて優れた結果を出すケースが多いのです。

特に中小企業においては、エンタープライズ向けの大規模AIプラットフォームを導入しても、使いこなせる人材がいない、設定が複雑すぎてカスタマイズに外部委託が必要になる、結果としてコストだけが膨らむ——というパターンが散見されます。

回避策:ツール選定の際は「自社の課題解決に必要な最低限の機能は何か」を明確にし、必要十分なスペックのツールを選びましょう。まずはシンプルなツールで小さく始め、成果が出てから高機能なツールへのアップグレードを検討する段階的アプローチが効果的です。

パターン8:データ整備コストの見落とし

AIツールの導入費用は見積もりに含まれていても、そのAIを適切に動かすために必要なデータの整備コストが抜け落ちているケースは非常に多いです。

AIは学習データの質に大きく依存します。「ゴミを入れれば、ゴミが出てくる(Garbage In, Garbage Out)」という原則は、AIにおいてもまったく変わりません。社内の業務データが紙ベースでしか存在しない、部門ごとにフォーマットがバラバラ、重複・欠損・誤記が多い——こうした状態のまま AIを導入しても、精度の低いアウトプットしか得られません。

データ整備には想定以上の時間とコストがかかります。データのクレンジング、フォーマット統一、ラベリング、さらにはデータ収集プロセスの構築まで含めると、AI導入プロジェクト全体のコストの50%以上がデータ関連に費やされるケースも珍しくありません。

回避策:AI導入の予算計画を立てる際は、ツールのライセンス費用だけでなく、データ整備にかかる人件費・外注費・期間も必ず見積もりに含めてください。自社のデータの現状を棚卸しし、AI活用に必要な品質水準とのギャップを事前に把握しておくことが重要です。

パターン9:セキュリティ要件との不整合

AI導入にあたって、情報セキュリティの観点からの検討が不十分なままプロジェクトを進めてしまう失敗パターンです。

特に生成AIツールにおいては、入力したデータがAIモデルの学習に利用される可能性、データの保存場所(国内か海外か)、SOC 2などのセキュリティ認証の有無、プライバシーポリシーの内容など、確認すべき事項は多岐にわたります。

2025年3月に改訂された経済産業省の「AI事業者ガイドライン(第1.1版)」や、2025年2月に公表された「AIの利用・開発に関する契約チェックリスト」でも、AIツールの利用に伴うセキュリティリスクへの対処が求められています。

PwCの調査でも、日本企業において生成AIを「コンプライアンス・企業文化に脅威を及ぼすもの」と認識する割合が前回調査から大幅に増加しており、セキュリティリスクへの意識は高まっています。しかし、意識は高まっていても、実際の対策が追いついていない企業が多いのが実態です。

回避策:AIツールの選定段階で、情報セキュリティ部門やコンプライアンス部門を必ず巻き込んでください。データの取り扱いポリシー、保存場所、学習利用の有無、セキュリティ認証の取得状況など、チェックリスト形式で確認・評価するプロセスを導入することを推奨します。

AI導入におけるセキュリティリスクについてはこちら、情報漏洩についてはこちらをご参照ください。

パターン10:PoC環境と本番環境のギャップを甘く見る

PoCでは順調に動いていたAIが、本番環境に移行した途端に想定どおりのパフォーマンスを発揮しない——この「PoCと本番の壁」は、AI導入における典型的な技術的失敗です。

PoCはテストデータ・限定的なユーザー数・理想的な条件下で実施されることが多いため、本番環境で直面する課題(大量データの処理速度、既存システムとの連携、セキュリティ制約、ネットワーク遅延など)が見えにくくなります。

MITのレポートが指摘する「95%のカスタムAIツールが本番到達しない」という数字の裏には、まさにこのPoCから本番への移行の難しさがあります。

回避策:PoCの設計段階から、本番環境に近い条件でのテストを計画してください。テストデータは本番データ(または本番に近い品質・量のデータ)を使用し、既存システムとの連携テスト、負荷テスト、セキュリティテストも含めた総合的な検証を行うことが重要です。

【組織の失敗】パターン11〜15

パターン11:現場を巻き込まないトップダウン導入

経営層がAI導入の号令をかけ、情報システム部門がツールを選定し、現場に「使え」と通達する——この進め方では、現場の実態に合わないツールが導入されたり、使い方が定着しなかったりする問題が発生します。

BCGの調査では、日本の一般従業員で日常的にAIを業務利用している割合は33%にとどまり、世界平均の51%を大きく下回っています。経営層のうち日常的にAIを利用する人は60%で、こちらも世界平均から25ポイント低い結果です。

さらに深刻なのは、「シャドーAI」の問題です。BCG調査では、回答者の54%以上が「正式に許可されていなくてもAIツールを使う」と回答しています。会社が提供する公式ツールよりも、個人で使い慣れたChatGPT等の方が使いやすいと感じる従業員が多いのです。

現場の声を聞かずにトップダウンでAIを導入すると、現場が本当に必要としている機能とのミスマッチが起きやすく、結果として「使われないAI」と「管理できないシャドーAI」が並存する状態に陥ります。

回避策:AI導入のプロセスに、初期段階から現場の担当者を参画させてください。業務の課題を最もよく知っているのは現場です。現場ヒアリングを通じて業務課題を特定し、ツール選定やPoCの段階でも現場のフィードバックを反映する体制を構築しましょう。

パターン12:AI人材の不在・育成の後回し

JUASの「企業IT動向調査2025」では、DX推進における最大の課題として「人材・スキルの不足」が79.3%で圧倒的なトップに挙げられています。

AI導入に際して必要なのは、データサイエンティストのような高度な専門人材だけではありません。AIツールを日常業務で活用できる「AI活用人材」、プロジェクトを推進できる「AI企画人材」、導入の意思決定ができる「AIリテラシーを持つ経営層」——このように複数のレイヤーでの人材育成が求められます。

しかし多くの企業では、AIツールを導入してから「使いこなせる人がいない」と気づく後手の対応に陥っています。BCGの調査でも、6時間以上のAIトレーニングを受けた従業員はAIを日常的に活用する可能性が高まるとのデータが示されていますが、そうした研修を体系的に実施している企業はまだ少数です。

回避策:AI導入のプロジェクト計画に、必ず人材育成の予算と期間を組み込んでください。全社員を対象としたAIリテラシー研修、実務担当者向けのハンズオン研修、推進リーダー向けのマネジメント研修など、階層別のプログラムを設計することが効果的です。

パターン13:既存業務フローとの不整合

AIツールの機能だけに注目してしまい、それが既存の業務フローにどのように組み込まれるかを十分に検討しないまま導入してしまうケースです。

たとえば、AIで自動作成した議事録をそのまま活用するには、会議の録音方法、発言者の識別方法、議事録のフォーマット、確認・承認フロー、保存場所など、周辺の業務プロセスも一緒に見直す必要があります。しかし、AIツールの導入だけが先行し、こうした周辺プロセスの調整が後回しにされると、「AIは動いているが業務全体の効率は上がらない」という結果になります。

PwCの調査で指摘されているとおり、成功企業は生成AIを中核プロセスに統合しているのに対し、失敗企業は断片的にツールとして利用するにとどまっています。この違いは、業務フロー全体の再設計を行っているかどうかに直結しています。

回避策:AI導入前に、対象業務の業務フロー全体を可視化してください。AIが担う部分だけでなく、その前後の工程も含めたEnd-to-Endの流れを設計し、AIの出力を次の工程にどう引き渡すか、人間の判断が必要なポイントはどこか、例外処理はどうするかを明確にしましょう。

パターン14:部門間のサイロ化による連携不全

AI導入の効果を最大化するには、部門横断的なデータ連携や業務連携が不可欠です。しかし、多くの日本企業では部門ごとにシステムや業務プロセスが分断された「サイロ状態」にあり、これがAI導入の障壁となっています。

たとえば、営業部門のCRMデータ、マーケティング部門のWeb分析データ、経理部門の販売実績データがそれぞれ別のシステムに格納され、連携されていない状態では、AIによる横断的な分析や予測は困難です。

また、AI導入プロジェクト自体が特定部門に閉じてしまい、他部門のノウハウや要件が取り込まれないまま進むことも問題です。情報システム部門だけでツールを選定し、利用部門のニーズを反映しない。あるいは、利用部門が独自にAIツールを導入し、情報システム部門のセキュリティ審査を通していない。こうした部門間の分断は、AI導入の失敗に直結します。

回避策:AI導入プロジェクトには、利用部門・情報システム部門・経営企画部門・コンプライアンス部門など、関連する部門の代表者を含めたクロスファンクショナルチームを組成してください。また、データ基盤の統合やAPI連携による部門間のデータ共有基盤の整備を、AI導入と並行して進めることが重要です。

パターン15:「AIに仕事を奪われる」という不安への対処不足

BCGの調査では、回答者全体の41%が今後10年でAIによる自動化が雇用に影響を及ぼすと考えています。従業員がAI導入に対して漠然とした不安や抵抗感を持っているのは自然なことです。

問題なのは、この不安に対して企業が適切にコミュニケーションを取らないまま、AIの導入を進めてしまうことです。「AIに自分の仕事を奪われるのではないか」という不安が放置されると、導入への抵抗、非協力的な態度、最悪の場合はサボタージュにまでつながる可能性があります。

一方で、BCGの調査ではAIエージェントの仕組みを理解している人ほどAIを脅威ではなく「協働パートナー」として捉えている、という興味深い結果も出ています。正しい知識と適切なコミュニケーションによって、不安は軽減できるのです。

回避策:AI導入の目的が「人員削減」ではなく「業務の高度化・付加価値向上」であることを、経営層が明確にメッセージとして発信してください。AIが代替する業務と、人間がより注力すべき業務を具体的に示すことで、従業員の理解と協力を得やすくなります。

【運用の失敗】パターン16〜20

パターン16:PoC止まり(いわゆる「PoC死」)

AI導入における最も有名な失敗パターンのひとつです。PoCまでは順調に進むものの、本番導入の判断ができず、いつまでもPoCが繰り返される「PoC地獄」に陥るケースです。

MITのレポートによれば、大企業ほどこの傾向が強く、パイロットから本番導入までの期間は中堅企業が約90日であるのに対し、大企業では9カ月以上を要しています。大企業の方がパイロットの数は多いものの、本番導入に至る割合は最も低いのです。

PoC死が起きる原因は複合的です。PoCの成功基準が曖昧、本番導入の判断基準が未定義、承認プロセスが複雑で時間がかかる、リスクを取る意思決定者がいない、「もう少しデータを集めてから」と先延ばしにしてしまう——こうした要因が重なり合って、プロジェクトが停滞します。

回避策:PoCの開始前に、「どの条件を満たしたら本番導入に進むか」の判断基準を明確に定めてください。期間も区切り、たとえば「3カ月以内にPoC結果を出し、1カ月以内に本番判断を行う」など、具体的なスケジュールをコミットしましょう。判断基準を満たさなかった場合に「撤退する」という選択肢もあらかじめ合意しておくことが重要です。

AI導入におけるPoC地獄については、こちらのコラムでも解説しているので参考にしてみてください。

パターン17:効果測定の仕組みが未構築

パターン2で述べたKPI未設定とも関連しますが、KPIを設定していたとしても、それを継続的に測定・モニタリングする仕組みが整っていなければ意味がありません。

AI導入後、最初の1〜2カ月は注目度が高く効果測定も行われますが、時間が経つにつれて測定が疎かになり、やがて「AIが入っているが、効果があるのかないのかわからない」状態に陥るケースは非常に多く見られます。

効果測定が行われなくなると、改善のサイクルが回らなくなるだけでなく、経営層からの投資継続の承認も得にくくなります。結果として、効果を出せていたかもしれないAIプロジェクトが予算削減の対象となり、自然消滅するという悪循環に陥ります。

回避策:導入前に効果測定のダッシュボードやレポーティングの仕組みを構築してください。月次や四半期ごとのレビュー会議を定例化し、KPIの達成状況を経営層に報告するプロセスを運用に組み込みましょう。測定結果に基づいた改善アクションを継続することで、AI導入の効果を段階的に高めていくことができます。

AI導入における投資対効果の正しい測定方法については、こちらの記事で詳しく解説しています。

パターン18:モデルの精度劣化(ドリフト)の放置

AIモデルは「一度構築したら終わり」ではありません。時間の経過とともに、学習データと実際のデータの分布が変化する「データドリフト」や「コンセプトドリフト」が発生し、AIの精度が徐々に低下していきます。

たとえば、コロナ禍前のデータで学習した需要予測AIは、パンデミック後の消費行動の変化に対応できません。同様に、為替変動、法改正、市場環境の変化、顧客層の変化など、さまざまな要因がAIの精度に影響を与えます。

しかし、AIモデルの精度を定期的にモニタリングし、必要に応じて再学習やチューニングを行う体制を整えている企業は少数派です。導入時には高い精度を示していたAIが、半年後・1年後にはほとんど使い物にならなくなっていた——という事態は決して珍しくありません。

回避策:AI導入の運用計画に、精度モニタリングと再学習のスケジュールを必ず含めてください。定量的な精度指標を定め、閾値を下回った場合のアラートと対処フローを事前に設計しておくことが重要です。

パターン19:コンサルタント依存でノウハウが社内に残らない

AI導入をコンサルティング会社や外部ベンダーに丸投げし、自社にノウハウが蓄積されないまま運用フェーズに入ってしまうケースです。

外部専門家の支援を受けること自体は有効な選択肢です。しかし、要件定義からツール選定、PoCの設計・実施、本番導入のすべてを外部に委託し、社内のメンバーが実質的に「お客様」になってしまうと、次のような問題が発生します。

まず、コンサルタントの契約終了後に、運用・保守・改善を自社で行えなくなります。次に、新たな課題が出るたびに外部への依頼が必要になり、コストが膨らみ続けます。さらに、AI活用のノウハウが社内に蓄積されないため、次のAIプロジェクトでも同じように外部依存が繰り返されるのです。

回避策:外部支援を活用する際は、自社メンバーの「学習機会」としても位置づけてください。コンサルタントと社内メンバーの協働体制を組み、ナレッジトランスファー(知識移転)の計画を契約に含めましょう。プロジェクト終了後に自走できる状態を目指すのが理想です。

AIコンサルタントについての完全ガイドは、こちらの記事で詳しく解説しています。

パターン20:補助金獲得が目的化し、導入後に放置

2026年3月から受付が開始される「デジタル化・AI導入補助金」をはじめ、AIに関連する公的支援制度は充実しています。補助金を活用してAI導入コストを抑えること自体は賢明な判断です。

しかし、「補助金をもらうこと」が目的化してしまい、補助金の交付要件を満たすための形式的な導入に終始するケースが散見されます。補助金の申請・交付までは熱心に取り組むものの、交付後は利用状況の報告義務を最低限こなすだけで、実質的な活用が行われないまま放置されるのです。

補助金はあくまでAI導入の「手段」であり、目的は事業課題の解決と業務改善です。この本末転倒を防ぐには、補助金の有無にかかわらず必要な投資であるかどうかを、まず冷静に判断する視点が重要です。

回避策:補助金の申請前に、「補助金がなかったとしてもこのAI投資を行うか?」と自問してください。Yesであれば補助金は純粋なコスト削減策として有効ですが、Noであれば投資自体の妥当性を再検討すべきです。また、補助金申請の事業計画を策定する時点で、導入後の効果測定計画と継続運用体制も具体化しておきましょう。

AI導入補助金の採択率を上げる方法については、こちらの記事で詳しく解説しています。

第3章:失敗企業と成功企業を分ける3つの分岐点

ここまで20の失敗パターンを見てきましたが、すべてのパターンに共通する「失敗と成功の分岐点」を整理すると、次の3つに集約されます。

分岐点1:経営層のリーダーシップと明確なビジョンがあるか

PwCの5カ国比較調査で明確に示されたとおり、AI活用で高い効果を上げている企業には「経営変革の目的を持った経営陣のリーダーシップ」が共通して存在します。一方、効果が出ていない企業では推進が現場任せになっています。

BCGの調査でも同様に、経営リーダーが積極的にAI活用に関与している組織では、AIの利用率も、AI導入に対して前向きな従業員の割合も明確に高いことが示されています。

重要なのは、経営層自身がAIを「単なる業務効率化のツール」ではなく「事業構造を変革する手段」として捉え、そのビジョンを組織全体に浸透させることです。

分岐点2:業務プロセスへの本格的な統合があるか

MITのレポートが指摘する「GenAI Divide」の最大の原因は、AIの性能差ではなく、業務プロセスへの統合度の差です。

成功企業はAIを既存のワークフローに組み込み、業務プロセスそのものを再設計しています。BCGが提唱する「10:20:70の法則」——リソースの70%を人材・業務プロセス・カルチャーの変革に充てる——はまさにこの点を強調しています。

AIツールを導入しただけで業務が変わることはありません。AIの出力をどう活用するか、人間の判断が必要なポイントはどこか、例外処理はどうするか——こうした業務設計の作り込みこそが、成功と失敗を分けます。

分岐点3:効果測定と継続改善の仕組みがあるか

JUASの調査で浮き彫りになった「効果測定の不在」は、日本企業特有の課題です。導入することがゴールになり、導入後の効果検証がおざなりになるケースが非常に多いのです。

成功企業は、導入前にKPIを設定し、ベースラインを計測し、導入後は定期的に効果を測定・報告し、その結果に基づいて改善アクションを実行するPDCAサイクルを回しています。

AI導入は「一度やれば終わり」のプロジェクトではなく、継続的な改善を前提とした取り組みです。効果測定の仕組みを構築し、データに基づいた意思決定を続けること——それが、失敗する95%から成功する5%へと移行するための最も確実な方法です。

第4章:失敗を防ぐためのAI導入チェックリスト

本章では、AI導入プロジェクトの各段階で確認すべき実践的なチェックリストを提示します。すべての項目を完璧にクリアする必要はありませんが、「確認していない」項目が多い場合は、プロジェクトの進め方を見直すシグナルとして受け止めてください。

導入前チェック(10項目)

①課題定義:AIで解決したい業務課題が明確に定義されていますか? 「AIを導入すること」自体が目的になっていませんか?

②KPI設定:導入によって達成したい定量目標(KPI)が設定されていますか? 導入前のベースラインは計測済みですか?

③経営層のコミットメント:経営層がAI導入の意義を理解し、推進に積極的に関与していますか? 予算・人員の確保に責任を持っていますか?

④現場参画:AIを実際に使う現場の担当者が、プロジェクトの初期段階から参画していますか? 現場の業務課題をヒアリングしていますか?

⑤データ現状確認:AIに必要なデータの種類・量・品質を把握していますか? データ整備に必要な工数・コストを見積もっていますか?

⑥セキュリティ要件:情報セキュリティ部門の確認を受けていますか? 取り扱うデータの機密レベルに応じたセキュリティ要件を定義していますか?

⑦業務フロー設計:AIを組み込んだ新しい業務フローを設計していますか? AI導入前後での業務の変化を整理していますか?

⑧撤退基準:PoCの成功・失敗の判断基準を事前に定めていますか? 「うまくいかなかった場合に撤退する」という選択肢も含めて合意していますか?

⑨人材育成計画:AI活用に必要な人材のスキルセットを定義し、育成計画を策定していますか?

⑩投資対効果の試算:初期コストだけでなく、ランニングコスト(ライセンス料、保守費、データ更新費)も含めた総コストと、期待される効果を試算していますか?

ツール選定時チェック(5項目)

①複数製品の比較:1社のベンダー提案だけでなく、3社以上の製品を同一基準で比較していますか?

②実データでの検証:デモ環境だけでなく、自社の実データを用いてPoC検証を行いましたか?

③セキュリティ審査:データの保存場所、学習利用の有無、セキュリティ認証、利用規約の内容を確認しましたか?

④トータルコストの把握:ライセンス費用に加え、導入支援費・カスタマイズ費・データ連携費・研修費など、トータルの導入コストを把握していますか?

⑤解約条件の確認:契約期間の縛り、解約時のデータ返却条件、移行支援の有無を確認しましたか?

導入後チェック(5項目)

①効果測定の実施:設定したKPIに基づいた効果測定が定期的(月次または四半期)に行われていますか?

②利用状況の把握:実際にAIを使っている従業員の数・頻度を把握していますか? 利用率が低い場合、原因を特定していますか?

③精度モニタリング:AIの出力精度が導入時の水準を維持しているかをモニタリングしていますか?

④改善サイクルの稼働:効果測定の結果に基づいて、改善アクションを実行するPDCAサイクルが回っていますか?

⑤ノウハウの蓄積:AI活用のベストプラクティスやトラブル対応の知見が、社内のナレッジとして蓄積・共有されていますか?

まとめ:「95%の失敗」を回避するために

本記事では、AI導入における20の失敗パターンと、それらを回避するための実践的な対策をご紹介しました。

改めて強調しておきたいのは、AI導入の成否を分けるのは「技術の優劣」ではなく、「導入プロセスの設計」であるということです。どれほど優れたAIツールを選んでも、課題定義が曖昧なまま導入すれば成果は出ません。逆に、シンプルなツールであっても、明確な目的と適切なプロセスのもとで導入すれば、着実な効果を生み出すことができます。

BCGが示した「10:20:70の法則」は、このことを端的に表しています。アルゴリズムに10%、データ・テクノロジーに20%、そして人材・業務プロセス・カルチャーの変革に70%——投資の重心を技術ではなく「人と組織」に置くこと。これが、失敗する95%から成功する5%の側に回るための最も確実なアプローチです。

とはいえ、自社だけですべてを判断するのは難しいかもしれません。

「ベンダーの提案が本当に自社に合っているのか」「PoCの結果をどう評価すべきか」「セキュリティリスクに見落としはないか」——こうした判断に不安を感じたら、ベンダーでもコンサルタントでもない、第三者の視点を取り入れることをご検討ください。

Aixisの第三者AI監査について

Aixisは、AIツールの販売や開発を一切行わない、完全に中立なAI監査機関です。ベンダーからの広告費や紹介料を受け取らないため、利害関係のないフラットな立場からAIツールの評価・検証を行うことができます。

これまで100件以上のAIツール検証を実施してきた知見をもとに、次のようなサービスを提供しています。

スポット監査は、特定のAIツールやベンダー提案の妥当性を第三者の目で検証するサービスです。「このベンダーの提案は適正か?」「PoC結果の評価は妥当か?」といった個別の判断に対して、データに基づいた客観的な評価を提供します。

比較選定監査は、複数のAIツール候補を統一基準で比較評価し、自社の要件に最も適したツールの選定を支援するサービスです。機能面だけでなく、セキュリティ、コスト効率、運用・サポート体制まで含めた総合的な評価を行います。

ガバナンス監査は、AI導入・運用に関するリスク管理体制やガイドラインの整備状況を評価し、改善提言を行うサービスです。経済産業省のAI事業者ガイドラインへの準拠状況の確認も含みます。

AI導入の失敗リスクを事前に可視化し、「成功する5%」の企業に近づくための第一歩として、Aixisの第三者監査をぜひご活用ください。

出典・参考資料

- MIT Media Lab, Project NANDA「The GenAI Divide: State of AI in Business 2025」(2025年7月)

- PwC Japanグループ「生成AIに関する実態調査2025春 5カ国比較」(2025年6月)

- 一般社団法人日本情報システム・ユーザー協会(JUAS)「企業IT動向調査2025」(2025年2月速報)

- ボストン コンサルティング グループ(BCG)「From Potential to Profit: Closing the AI Impact Gap」(2025年1月)

- ボストン コンサルティング グループ(BCG)「AI at Work 2025: Momentum Builds, But Gaps Remain」(2025年7月)

- 経済産業省「AI事業者ガイドライン(第1.1版)」(2025年3月改訂)

- 経済産業省「AIの利用・開発に関する契約チェックリスト」(2025年2月)