2026年1月、IPA(独立行政法人 情報処理推進機構)が発表した「情報セキュリティ10大脅威 2026」で、「AIの利用をめぐるサイバーリスク」が初選出にして第3位にランクインしました。

ランサムウェア、サプライチェーン攻撃に次ぐこの順位は、AIに関連するセキュリティリスクがもはや「将来の懸念」ではなく「今そこにある危機」であることを示しています。

さらに衝撃的なのが、Ciscoが2025年に発表した「サイバーセキュリティレディネスインデックス」の数値です。

同レポートによれば、過去1年間にAI関連のセキュリティインシデントを経験したビジネスリーダーは実に86%にのぼります。

「AIを導入したいが、セキュリティが不安」「社員が勝手にChatGPTに社内情報を入力していないか心配」——。こうした声は、企業規模を問わず日本中の経営現場で広がっています。

本記事では、国内外の最新調査データを網羅的に引用しながら、特定のAIベンダーに偏らない中立的な視点から、企業のAI導入時に知っておくべきセキュリティリスクとその具体的な対策を解説します。

なぜ今「AI導入×セキュリティ」が経営課題なのか

数字が示す「AIセキュリティ」の緊急度

AIに関連するセキュリティリスクの深刻さは、複数の権威ある調査が一致して示しています。

まず冒頭でも触れたIPAの「情報セキュリティ10大脅威 2026」です。

IPA は毎年、情報セキュリティ分野の研究者や企業の実務担当者など約250名で構成する選考会の投票によってランキングを決定しています。

2026年版で「AIの利用をめぐるサイバーリスク」が初めて脅威候補に選出され、いきなり第3位に入ったことは、現場レベルでのAIセキュリティに対する危機意識の高まりを端的に表しています。

(出典:IPA「情報セキュリティ10大脅威 2026」2026年1月29日発表)

グローバルでも同様の傾向が確認されています。

世界経済フォーラムの「グローバル・サイバーセキュリティ展望」レポートでは、調査対象となった組織の66%が、今年サイバーセキュリティに最も大きな影響をもたらすのはAIであると回答しました。

Stanford大学の最新サイバーセキュリティ分析でも、AI主導のインシデントが前年比で56%増加したとの結果が報告されています。

(出典:世界経済フォーラム「グローバル・サイバーセキュリティ展望」、Stanford University Cybersecurity Analysis)

こうしたデータが示す結論は明確です。AIの活用が進むほど、セキュリティリスクも比例して拡大するということ。

そしてそのリスクは、すでに多くの企業が現実の被害として体験しているのです。

日本企業に広がる「認識と対策のギャップ」

日本の企業も例外ではありません。しかし深刻なのは、リスクを認識しながらも対策が追いついていないという構造的な問題です。

総務省が2025年に発表した「令和7年版 情報通信白書」によれば、日本企業が生成AI導入に際して抱える懸念事項の第2位に「社内情報の漏えい等のセキュリティリスク」が挙げられています。

つまり、多くの企業がセキュリティを気にしている。しかし、「気にしている」ことと「対策を講じている」ことは別問題です。

(出典:総務省「令和7年版 情報通信白書」2025年)

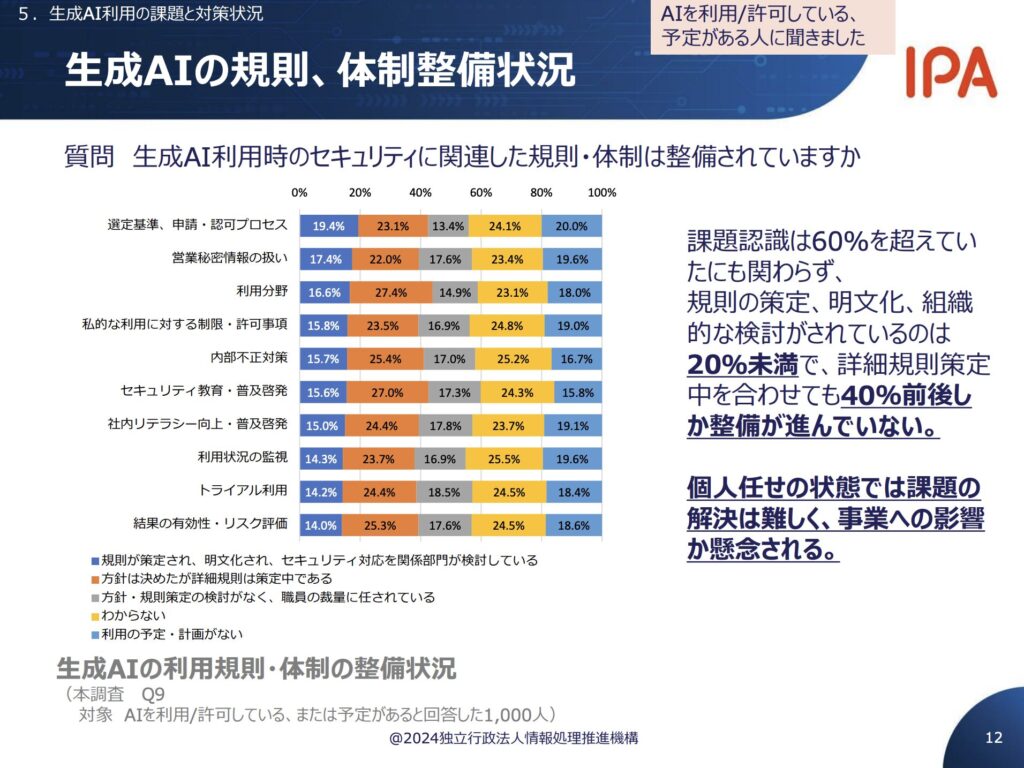

IPAが2024年7月に公開した「AI利用時のセキュリティ脅威・リスク調査報告書」は、このギャップを数字で浮き彫りにしています。

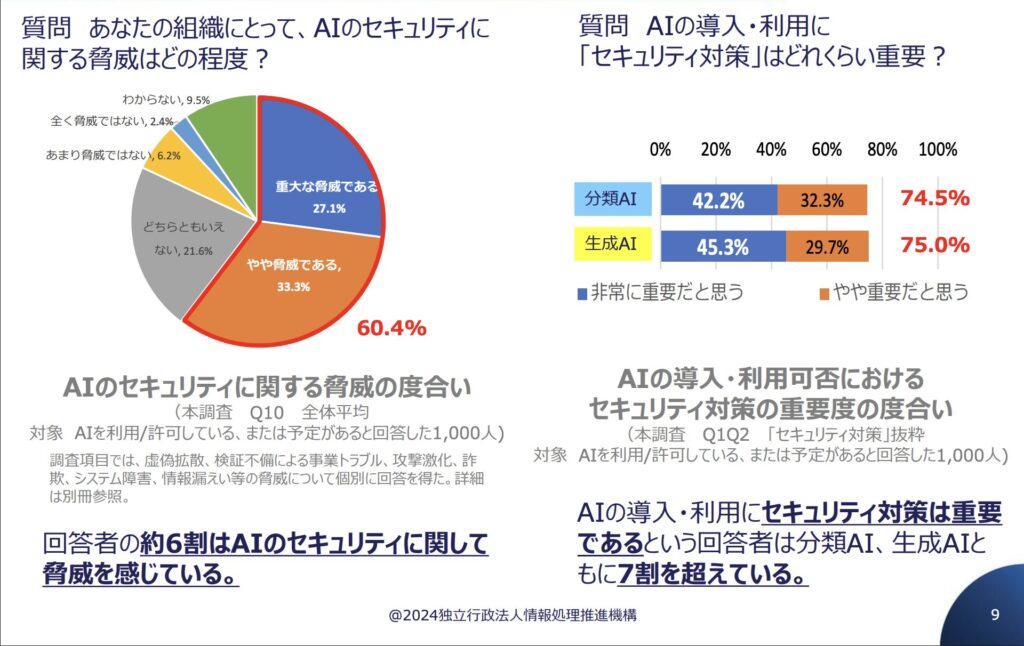

同調査(n=1,000)では、AIのセキュリティに関する脅威を「重大な脅威である」または「やや脅威である」と回答した人が全体平均で60.4%、セキュリティ対策の重要度についても生成AI利用者の75.0%が「重要だと思う」と回答しました。

一方で、AIに関するセキュリティ規則を明文化している企業は2割未満にとどまっています。

(出典:IPA「AI利用時のセキュリティ脅威・リスク調査報告書」2024年7月、n=1,000)

Accentureの「サイバーセキュリティ・レジリエンスの現状 2025」レポートはさらに厳しい数字を突きつけます。

生成AIの活用に関して明確なポリシーと研修を導入している組織は、世界全体でも22%にすぎず、日本に限ればわずか19%です。

(出典:Accenture「サイバーセキュリティ・レジリエンスの現状 2025」)

人材面の課題も深刻です。

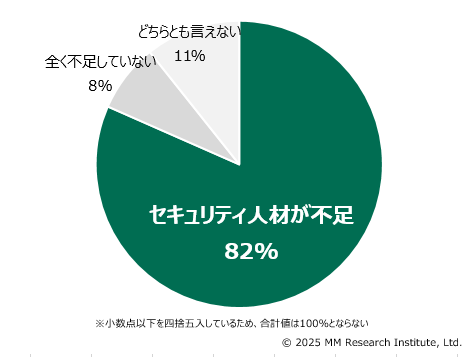

MM総研が2025年7月に実施した「民間企業におけるサイバーセキュリティ対策の動向調査」(n=1,000)では、企業の82%がセキュリティ分野の人材不足を認識していると回答しています。

特に過去にインシデントを経験した企業ほど、この不足を深刻に捉える傾向が確認されています。

つまり、日本企業の現状はこうです。

約6割がAIのセキュリティリスクを脅威と認識し、7割以上が対策の重要性を理解している。

にもかかわらず、ポリシーを明文化できている企業は2割未満。しかも対策を実行する人材が8割以上の企業で不足している。

この「認識と対策のギャップ」こそが、日本企業のAIセキュリティにおける最大のリスクと言えるでしょう。

AI導入で企業が直面する「5つのセキュリティリスク」

AIに関するセキュリティリスクは多岐にわたりますが、企業が導入・運用の過程で直面するリスクは大きく5つに分類できます。

ここでは「AI自体をどう守るか」の観点を中心に整理します。

リスク①:意図しない情報漏えい

企業のAI活用において最も身近で、かつ最も頻繁に発生しているリスクがこれです。

たとえば、従業員が業務効率化のためにChatGPTなどの生成AIに社内の機密情報を入力するケース。

無料版や一部のプランでは、入力された情報がAIの学習データとして利用される可能性があります。

つまり、ある社員が入力した機密情報が、別のユーザーへの回答の中に何らかの形で反映されてしまうリスクがあるのです。

この問題が広く知られるきっかけとなったのは、韓国サムスン電子で発生した事案です。

従業員がChatGPTにソースコードを入力したことで、社内の技術情報が外部に流出する可能性が生じ、同社は社内でのChatGPT利用を一時禁止する措置をとりました。

IPAの10大脅威2026でも、「AIに対する不十分な理解に起因する意図しない情報漏えいや他者の権利侵害」が脅威の一つとして明示的に挙げられています。

注意すべきポイント: 各AIツールのデータ取扱いポリシーはベンダーによって大きく異なります。

「学習に使われない」と謳っていても、その範囲や条件は契約プランごとに異なる場合があり、ベンダーが公表する情報だけで安全性を判断することには限界があります。

リスク②:AIを悪用したサイバー攻撃の高度化

AIは防御側だけでなく、攻撃側にとっても強力なツールです。

Trend Microが2,250名のIT/サイバーセキュリティ意思決定者を対象に実施した意識調査(2025年)では、セキュリティリーダーの93%が、2025年にはAIを利用した攻撃を日常的に受けるようになると予測しています。この予測は現実のものとなりつつあります。

(出典:Trend Micro「AIとセキュリティに関する意識調査」2025年、n=2,250)

具体的な攻撃手法の例として挙げられるのが、AIで生成された精巧なフィッシングメールやディープフェイクを使ったなりすましです。

従来のフィッシングメールは文面の不自然さから見抜けることも多かったのですが、生成AIの登場により、ITリテラシーの高いユーザーでさえ本物と見分けることが困難なレベルの攻撃が可能になっています。

さらに2025年には、AI駆動型と呼ばれるマルウェアも実際に報告されています。

Trend Microのレポートによれば、ウクライナの安全保障関連組織を狙った情報窃取マルウェア「LAMEHUG」は、バイブコーディング(AIにプロンプトを送信してプログラムを生成する手法)を活用して作成されたとみられています。

(出典:Trend Micro「法人セキュリティ脅威予測2026」2025年12月)

リスク③:AI生成コード・出力の脆弱性

AIが生成するコードやコンテンツそのものが、セキュリティ上の弱点となるリスクも無視できません。

セキュリティ企業Veracodeの調査によれば、バイブコーディングによって生成されたコードの45%が安全性に問題を抱えているとの結果が出ています。

AIが生成するコードは一見正しく動作するため、開発者がセキュリティレビューを省略しがちですが、そこに潜む脆弱性が本番環境に持ち込まれるリスクが高まっています。

(出典:Veracode調査、Trend Micro「法人セキュリティ脅威予測2026」より引用)

実際、Trend Microのテレメトリーデータによれば、バイブコーディングツールの利用は急拡大しており、2025年1月から9月にかけてLovableは660%、Vercelは57%の増加を記録しています。

利用が広がるほど、脆弱なコードが本番環境に投入される確率も高まることを意味します。

コード以外にも、AIの「ハルシネーション」(もっともらしいが事実と異なる出力)による誤判断リスクがあります。

AIの出力結果を十分に検証せずに業務判断に使ってしまうと、誤った情報に基づいた経営判断やサービス提供につながりかねません。

IPA も10大脅威2026の解説で、この「AIの出力を鵜呑みにするリスク」を明確に警告しています。

リスク④:プロンプトインジェクション・敵対的攻撃

AIシステム自体を攻撃する手法も巧妙化しています。

プロンプトインジェクションとは、悪意ある指示をAIシステムに与えることで、本来アクセスできない情報を引き出したり意図しない動作をさせたりする攻撃手法です。

セキュリティ研究者によって実証された事例では、Webページに人間には見えないテキスト(白文字や極小フォント)を埋め込み、そのページを参照したAIが不適切な応答をするよう誘導する手法が報告されています。

この分野の深刻さを象徴するのが、世界的に有名なハッキングコンテスト「Pwn2Own」に2025年、AI専用カテゴリーが新設されたことです。

これは単なる流行への対応ではなく、AIシステムのセキュリティが従来の情報システムと同等以上に重要な課題となっていることの証左です。

(出典:Trend Micro「AIセキュリティの現状レポート(2025年上半期)」2025年8月)

リスク⑤:コンプライアンス・規制対応リスク

AIの利活用に関する法規制は、国内外で急速に整備が進んでいます。

日本では2025年にAI推進法が成立し、AI事業者ガイドラインの整備も進行中です。

海外では、EUのAI Act(AI規制法)やサイバーレジリエンス法(CRA)がデジタル製品に対するセキュリティ要件を厳格化しており、日本企業もグローバルにビジネスを展開する限り、これらの規制への対応を避けて通ることはできません。

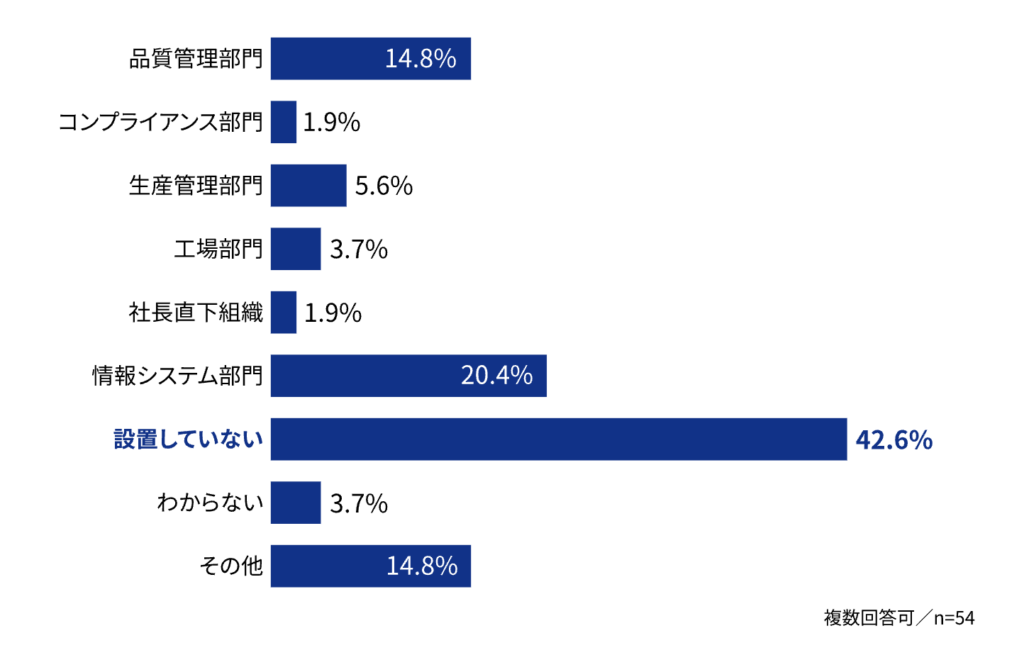

KPMGコンサルティングの「サイバーセキュリティサーベイ2025」では、社内に製品セキュリティ組織を設置していない企業が42.6%、製品セキュリティ活動で参照している法規・ガイドラインについて「わからない」と回答した企業が50.0%と、日本企業における規制対応の遅れが浮き彫りとなっています。

さらに、AIガバナンス協会が実施した会員企業の自己診断結果によれば、AIを開発・提供する企業と比べて、AIを「利用する」側の企業のガバナンススコアが著しく低いことが報告されています。

SaaS型のAI製品をそのまま調達・利用しているケースが多いとみられ、利用企業側のAIガバナンス整備が大きな課題として認識されています。

AI出力に含まれる著作権侵害のリスクも見過ごせません。社内で生成AIを活用する過程で、既存の著作物に酷似したコンテンツが無自覚に生成・利用されてしまう可能性があり、法的リスクにつながりかねません。

AI導入時のセキュリティ対策「5つのステップ」

リスクの全体像を把握したところで、ここからは実際に企業が取るべき対策を5つのステップで整理します。

重要なのは、技術的対策だけでなく、組織体制・ルール整備・人材育成を含めた包括的なアプローチです。

ステップ1:AIセキュリティポリシーの策定

対策の出発点は、社内でのAI利用に関する明確なルールを文書化することです。

IPA調査が示すように、AIに関するセキュリティ規則を明文化している企業はわずか2割未満。

しかし、ルールなき利用は「いつインシデントが起きてもおかしくない」状態そのものです。

ポリシーに盛り込むべき要素

- 利用可能なAIツールの指定: 会社として承認されたAIツールの一覧と、未承認ツールの使用禁止規定

- データ分類と入力制限: 機密レベルに応じて、AIへの入力が許可される情報とされない情報の区分

- 禁止事項の明確化: ディープフェイクの作成、他者の個人情報の無断入力、著作権侵害につながる利用などの明示的禁止

- インシデント発生時の報告フロー: 情報漏えいの疑い等が発生した場合の連絡先・対応手順

- 定期的な見直しスケジュール: AI技術や規制環境の変化に応じたポリシー更新の仕組み

ポリシー策定にあたっては、AIガバナンス協会が公開しているセルフチェックツールや、IPAのAI事業者ガイドラインを参照すると、自社の現在地と不足している領域を把握しやすくなります。

ステップ2:AIツール選定時のセキュリティ評価

AIツールの選定は、機能や使いやすさだけでなく、セキュリティ要件を軸に行うべきです。

最低限確認すべき評価ポイント

- データの学習利用有無: 入力データがAIの学習(モデル改善)に使われるか。使われる場合、オプトアウト(拒否)が可能か

- データの保管場所: 国内リージョンでのデータ処理に対応しているか(特に個人情報や機密情報を扱う場合)

- 暗号化の実装: 通信の暗号化(TLS)に加えて、保存データの暗号化がなされているか

- アクセス権限管理: ユーザーごとの利用権限設定、管理者による利用状況の把握が可能か

- 監査ログ機能: 誰が、いつ、どのような情報をAIに入力したかの記録が取得・確認できるか

- セキュリティ認証: SOC2、ISO 27001等の第三者認証を取得しているか

- インシデント対応体制: セキュリティインシデント発生時のベンダー側の対応方針・SLAが明示されているか

ここで重要なのは、これらの情報の多くはベンダー自身が公表する「自己申告」に基づいているということです。

Ciscoのレポートでは、機密データへのアクセス制御ソリューションを導入している企業は86%に達する一方、完全に実装できているのは51%にとどまるという実装ギャップが指摘されています。

ベンダーが「対応済み」と表明していても、実装の深さや運用実態は外部から見えにくいのが実情です。

だからこそ、ベンダーの情報だけに頼らず、利害関係のない第三者による客観的な検証を併用することが、リスクを実質的に低減するうえで有効です。

ステップ3:従業員教育とリテラシー向上

技術的な対策がいくら整備されていても、利用する従業員のリテラシーが不十分であれば、セキュリティホールは埋まりません。

Accentureのレポートが示すように、日本でAIに関する明確なポリシーと研修を整備している組織は19%にとどまっています。

教育不足は、意図しない情報漏えいの直接的な原因となります。

教育に盛り込むべき内容

- 生成AIの基本的な仕組み(なぜ入力データが漏えいリスクになるのか)

- プロンプトインジェクション等の攻撃手法の基礎知識

- 自社のAIセキュリティポリシーの理解と遵守

- AI出力を鵜呑みにしない検証姿勢の徹底

- インシデント発生時の報告手順の確認

教育は一度きりではなく、AI技術の進化や新たな攻撃手法の登場に応じて継続的にアップデートする必要があります。

特に、新しいAIツールの導入時には、そのツール固有のリスクを含めた研修を実施すべきです。

ステップ4:技術的対策の実装

組織的な整備と並行して、技術面での防御策も不可欠です。

主要な技術的対策

- シャドーAI対策: 従業員が無許可で利用しているAIツール(シャドーAI)を検出・管理する仕組みの導入。ネットワークレベルでのAIサービスへのアクセス制御が有効

- DLP(Data Loss Prevention)の活用: 機密情報がAIサービスへ送信される前にブロックするデータ損失防止ソリューション

- AI出力のレビュープロセス: 重要な業務判断や外部公開コンテンツにAI出力を使用する場合、人間による確認プロセスを必須化

- AIシステムのセキュリティテスト: 自社で開発・運用するAIシステムに対するペネトレーションテストや脆弱性診断の定期実施

MM総研の調査では、セキュリティ対策でAIを導入済みの企業は24%にとどまる一方、準備中・検討中の企業は53%に達しています。また、利用する領域としてはインシデント対応が69%と最も多く、次いでセキュリティ戦略・企画が51%となっています。自社の防御にAIを活用すること自体も、今後ますます重要なテーマとなるでしょう。

(出典:MM総研「民間企業におけるサイバーセキュリティ対策の動向調査」2025年7月)

ステップ5:継続的な監査とガバナンス体制の構築

セキュリティ対策は「導入して終わり」ではありません。AIの技術や脅威環境は急速に変化するため、継続的な監査と改善の仕組みが不可欠です。

Trend Microの調査では、サードパーティベンダの開示する脆弱性を定期的に評価・監視し、綿密なセキュリティ監査を実施している企業が46%にとどまっています。

逆に言えば、過半数の企業はベンダー側のセキュリティ状況を定期的に確認していないということです。

(出典:Trend Micro「AIとセキュリティに関する意識調査」2025年、n=2,250)

KPMGコンサルティングの調査でも、子会社の情報セキュリティ状況を「各社に委ねている」「把握していない」と回答した企業が合わせて約37%に達しており、サプライチェーン全体でのガバナンスに課題があることがわかります。

(出典:KPMGコンサルティング「サイバーセキュリティサーベイ2025」)

Gartnerが提唱する「AI TRiSM(AIの信頼、リスクおよびセキュリティ管理)」フレームワークは、AIのリスクを継続的に管理するための体系的な枠組みとして注目されています

。異常検知やデータ保護、アプリケーションの安全性確保を包括的にカバーするこのフレームワークを参考に、自社のガバナンス体制を設計することが推奨されます。

「第三者によるAI監査」が今、求められる理由

ここまでの5つのステップを実行するうえで、多くの企業が直面する壁があります。

それは、「自社だけでの評価・対策には限界がある」という現実です。

ベンダー評価の限界——自己申告だけでは安全を担保できない

AIツールを選定する際、企業が頼りにできる情報の大半はベンダー自身が発信したものです。

しかし、ベンダーにはツールを販売するという利害関係がある以上、セキュリティに関する情報発信にはどうしても「ポジティブバイアス」がかかります。

先に引用したCiscoの調査が示すように、セキュリティ対策の「導入済み」と「完全な実装」の間には大きなギャップが存在します。

機密データのアクセス制御においても、導入企業は86%に達する一方、完全実装は51%にとどまります。ベンダーが「対応済み」と公表している内容と、実際の実装レベルが一致しているかは、外部から確認しなければわかりません。

Stanford大学の調査でも、セキュリティ意識と実装の間に大きなギャップがあることが指摘されており、企業がリスクを理解していても、その知識を有効なアクションに変えるのが難しい現状が浮き彫りになっています。

社内リソースの制約——82%が人材不足を訴える現実

MM総研の調査が示すとおり、企業の82%でセキュリティ人材が不足しています。

AIのセキュリティ評価には、従来のITセキュリティに加えて、機械学習モデルの特性やAI固有の攻撃手法に関する専門知識が求められます。

こうした高度な専門性を社内で確保することは、多くの企業にとって現実的に困難です。

同調査では、セキュリティ対策に積極的な企業ほど外部委託の比率が高い傾向も確認されています。

外部委託で基本的な対策を進めた企業が、さらなる高度化のためにAI活用や第三者監査を積極的に試みるという流れが生まれています。

AIセキュリティ監査で確認すべき7つの観点

AIツールの導入にあたって、第三者の視点から客観的に検証すべき主要な観点は以下の7つです。

- データの取扱いポリシー: 入力データの学習利用有無、データの保存期間・削除ポリシー

- 暗号化の実装状況: 通信時・保存時のデータ暗号化の強度と実装レベル

- アクセス制御と権限管理: ユーザー認証の多層性、管理者権限の適切な運用

- 監査ログの可用性: 操作履歴の記録範囲、保存期間、検索・分析の容易さ

- インシデント対応体制: セキュリティインシデント発生時の検知・報告・復旧プロセス

- コンプライアンス適合性: 国内外の規制(AI推進法、EU AI Act等)への対応状況

- AI出力の品質と信頼性: ハルシネーション発生率、出力のバイアス傾向、精度の安定性

これらの観点を、利害関係のない第三者が体系的に評価することで、ベンダーの自己申告だけでは見えないリスクを可視化し、経営層が根拠に基づいた導入判断を下すことが可能になります。

まとめ——AI導入を「攻め」にするために「守り」を固める

AI導入はもはや「するかどうか」ではなく、「いかに安全に進めるか」のフェーズに入っています。

本記事で紹介した調査データが示すのは、以下の3つのファクトです。

①AIセキュリティリスクはすでに顕在化している。 Ciscoの調査で86%のビジネスリーダーがインシデントを経験し、IPAの10大脅威でもAIリスクが第3位に初選出されました。

②日本企業の対策は大きく遅れている。 リスク認識は6割を超えるにもかかわらず、ポリシーの明文化は2割未満、AIに関する研修・ポリシーの整備は19%にとどまります。

③自社だけでの対策には限界がある。 セキュリティ人材が不足する企業は82%に達し、ベンダー評価の「認識と実装のギャップ」も指摘されています。

こうした現実を踏まえたとき、企業が今日から始めるべきアクションは明確です。

まずAIセキュリティポリシーを策定する。

次にツール選定時のセキュリティ評価を厳格化する。

従業員教育を実施する。

技術的対策を導入する。

そして、これらを継続的に監査・改善する体制を構築する。

AIの力を最大限に引き出すためには、セキュリティという「守り」を盤石にすることが前提条件です。

攻めの投資を守りの不備で台無しにしないよう、今のうちに体制を整えておくことが、中長期的な競争力の源泉になるでしょう。

よくある質問(FAQ)

Q. 企業がAI導入時に最も注意すべきセキュリティリスクは?

最も身近かつ頻繁に発生しているのは「意図しない情報漏えい」です。

従業員が生成AIに機密情報を入力し、そのデータがAIの学習に取り込まれるケースが多く報告されています。まずはデータ分類と入力制限のルールを整備することが第一歩です。

Q. AIセキュリティ対策として最初に何をすべき?

AIセキュリティポリシーの策定から始めましょう。IPAの調査によれば、セキュリティ規則を明文化している企業はわずか2割未満です。

利用可能なツールの指定、入力制限、禁止事項、報告フローなどを文書化し、全社に周知することが出発点です。

Q. AIツール選定時のセキュリティ評価ポイントは?

データの暗号化、学習データへのオプトアウト設定、アクセス権限管理、監査ログ機能、セキュリティ認証の有無が最低限の確認項目です。

ベンダーの公表情報だけでなく、利害関係のない第三者による客観的な検証を組み合わせることで、評価の精度を高められます。

Q. 中小企業でもAIセキュリティ対策は必要?

はい。MM総研の調査では企業の82%がセキュリティ人材不足を認識しており、中小企業ではこの傾向がさらに顕著です。

すべてを自社で対応するのは非現実的なため、外部の専門機関による支援やセキュリティ監査サービスの活用が効果的な選択肢となります。

Q. 生成AIの業務利用を全面禁止すべき?

全面禁止は現実的でなく、むしろ「シャドーAI」(無許可での利用)を助長するリスクがあります。禁止するのではなく、承認されたツールと利用ルールを明確にし、安全な環境で活用を推進することが推奨されます。

本記事は、特定のAIベンダーやセキュリティ製品を推奨するものではなく、公開されている調査データに基づき、ベンダーニュートラルな視点から執筆されています。

AIツール、本当にそのまま導入して大丈夫ですか?

Aixisは、特定のAIベンダーと利害関係を持たない独立系AI調査機関として、企業のAIツール選定・導入におけるセキュリティリスクを第三者の視点から検証します。

- ベンダーの自己申告ではない、中立的なセキュリティ評価

- 貴社のセキュリティ要件に基づいたAIツールの比較検証

- 導入前のリスク可視化レポートの提供